Apps & Mobile Entwicklung

KI-Infrastruktur in den USA: Hälfte der Rechenzentren für 2026 verzögert oder gestoppt

Immer wieder gibt es Meldungen, dass der Ausbau der KI-Rechenzentren in den USA nicht mit den Zeitplänen mithalten kann. Bloomberg nennt nun eine konkrete Zahl: Bei annähernd der Hälfte der für 2026 geplanten Projekte wird erwartet, dass diese sich verzögern oder komplett gestrichen werden.

Zentraler Grund ist laut dem Bloomberg-Bericht der Mangel an Komponenten für die elektrische Infrastruktur, konkret geht es also um Transformatoren, Schaltanlagen und Batterien. Entsprechende Bauteile sind nicht nur für die Rechenzentren erforderlich, sondern auch für den Ausbau der Stromnetze, die den enorm steigenden Verbrauch bewältigen müssen.

Laut Analysen des Thinktanks Sightline Climate sollen in diesem Jahr Rechenzentren ans Netz gehen, die rund 12 Gigawatt an Energie benötigen. Schätzungsweise befindet sich aber nur ein Drittel im Bau.

Trumps Handelspolitik schadet den Anbietern

Anbieter elektrischer Komponenten in den USA können die Nachfrage laut Bloomberg nicht mehr bewältigen. Die Tech-Unternehmen sind daher auf Importe aus aller Welt angewiesen. Genau diese Handelsbeziehungen sind aber durch die Zölle von US-Präsident Donald Trump beeinträchtigt. Ein großer Anteil der Komponenten wird etwa in China gefertigt.

Die US-Administration versucht zwar seit geraumer Zeit, die Produktionskapazitäten in den USA zu erhöhen. Wenn die Pläne der US-Anbieter für den KI-Ausbau umgesetzt werden sollen, ist man aber im großen Maß auf Produkte angewiesen, die in China hergestellt werden, heißt es im Bericht.

Durch die erhöhte Nachfrage, die der KI-Boom ausgelöst hat, steigen zudem die Preise für Komponenten wie Transformatoren. Teilweise haben diese sich laut dem Bericht verfünffacht. Teile sollen nun in größerer Stückzahl und kürzeren Zeiträumen geliefert werden. Wenn die Lieferzeit bei Bestellungen von Hochleistungstransformatoren vor dem Jahr 2020 typischerweise noch 24 bis 30 Monate betragen hat, wollen KI-Unternehmen die Komponenten aktuell in weniger als 18 Monaten.

Lieferkette elektrischer Komponenten als „wildes Puzzle“

Crusoe Energy Systems baut derzeit in Texas einen Datacenter-Campus. Laut Bloomberg ist das Unternehmen bekannt für die Geschwindigkeit. Laut eigenen Aussagen ist Crusoe in der Lage, Teile eines Rechenzentrums binnen eines Jahres ans Netz zu bringen. Ein Trick ist, frühzeitig eine ausreichende Menge elektrischer Komponenten zu kaufen. So konnte man Vorräte anlegen, bevor Handelsbarrieren errichtet worden sind.

Insgesamt machen die elektrischen Komponenten weniger als zehn Prozent der Kosten eines Rechenzentrums aus. Ohne diese Bauteile lässt es sich aber nicht in Betrieb nehmen. „Wenn sich ein Teil der Lieferkette verzögert, kann das komplette Projekt nicht fertiggestellt werden“, sagt Andrew Likens, Crusoes Direktor für Energie und Infrastruktur. Momentan sei es daher ein „ziemlich wildes Puzzle“.

Um ausreichend elektrische Komponenten auf Lager zu haben, hat Crusoe die Vorbestellungen deutlich erhöht. Nun kauft man schon Teile, obwohl noch nicht mal klar ist, ob es dafür einen Auftrag gibt. Riskanter, für Crusoe hat es sich aber als erfolgreiche Strategie erwiesen.

Auch bei den elektrischen Komponenten kommt es also zu Marktdynamiken, die vergleichbar sind mit der Speicherkrise.

Durch den Iran-Krieg erhöhte Strompreise verschärfen die Krise

Crusoe stand zuletzt aber auch im Fokus verzögerter und umgeplanter Projekte. Berichte kursierten, wonach ein Ausbauvorhaben von OpenAI und Oracle in Texas, das Crusoe im Rahmen von Stargate umsetzt, nicht wie geplant läuft. Die Beteiligten bezeichneten den Bloomberg-Bericht von Anfang März aber als falsch und irreführend.

Dass sich der Energiebereich immer mehr zum Flaschenhals entwickelt, war jedoch absehbar. Microsofts CEO Satya Nadella erklärte etwa im Januar, Chips seien nicht das Kernproblem. Herausfordernd wäre es, ausreichend Energie für neue Rechenzentren bereitzustellen.

- Big Tech setzt auf „Winner takes all“: 650 Mrd. Dollar an Investitionen für KI-Wettrüsten in 2026

Die KI-Investitionen sollen in diesem Jahr ein Rekordniveau erreichen. Allein die vier Big-Tech-Konzerne Amazon, Microsoft, Google und Meta haben Capex-Ausgaben in Höhe von rund 650 Milliarden US-Dollar angekündigt.

Neben den Engpässen bei technischen Komponenten ist aber der aufgrund des Iran-Kriegs steigende Strompreis ein weiteres Hemmnis. Angesichts der erwarteten Wachstumsschwäche gehen erste Analysten laut einem Bericht von Reuters davon aus, dass die Big-Tech-Konzerne die Höhe der Investitionen im Verlauf des Jahres noch zusammenstreichen werden.

Apps & Mobile Entwicklung

SandboxAQ: Claude erhält Modelle zur Wirkstoffforschung

Künstliche Intelligenz hat sich in der medizinischen Forschung längst etabliert und bereits eine Vielzahl neuer Wirkstoffe wie bislang unbekannte Antibiotika hervorgebracht und dabei die Kosten gesenkt. Ein großes Problem blieb bislang jedoch die komplizierte Bedienung vieler KI-Modelle für technisch weniger versierte Forscher.

Kein Problem der KI, sondern der Oberfläche

Zahlreiche KI-Startups in diesem Bereich haben es sich zum Ziel gesetzt, die kostenintensive Suche nach neuen Wirkstoffen nicht nur günstiger zu gestalten, sondern zugleich die Dauer der Forschung erheblich zu verkürzen. Dass dies technisch möglich ist, hatten zahlreiche Ergebnisse in der Vergangenheit bereits gezeigt. Das eigentliche Problem lag bislang jedoch häufig in der Bedienung der eingesetzten KI-Modelle. Manche Forscher vertraten sogar die Ansicht, dass für deren sinnvolle Nutzung praktisch ein Doktortitel in Informatik erforderlich sei.

Dieses Problem will SandboxAQ nun laut einem Bericht von TechCrunch gelöst haben. Dafür hat sich das Unternehmen mit Anthropic zusammengeschlossen. SandboxAQ wurde vor rund fünf Jahren als Teil von Alphabet gegründet, Vorstandsvorsitzender ist der frühere Google-CEO Eric Schmidt.

Eines der Tätigkeitsfelder des Unternehmens ist die Entwicklung großer quantitativer Modelle, sogenannter LQMs. Diese proprietären Modelle gelten als physikalisch fundiert, da sie nicht auf Mustern in Texten, sondern auf den Gesetzen der physikalischen Welt basieren und dadurch unter anderem quantenchemische Berechnungen durchführen können. Die Erforschung neuer Wirkstoffe lässt sich mit diesen nicht nur beschleunigen, sondern auch kostengünstiger gestalten, da viele Erkenntnisse bereits vorab aus Simulationen gewonnen werden können und ein erheblicher Teil der Arbeit nicht mehr in teuren Laborumgebungen erfolgen muss.

Zeiten und Kosten sollen gesenkt werden

Um den eigenen KI-Modellen eine leicht verständliche und zugleich praktikable Oberfläche bereitzustellen, hat das Startup seine wissenschaftlichen KI-Modelle mit Anthropics Claude kombiniert. Dadurch soll ein leistungsfähiges Werkzeug für Wirkstoffforschung und Materialwissenschaft entstehen, das hinter einer dialogorientierten Benutzeroberfläche arbeitet. Für dessen Einsatz sei weder spezielle IT-Infrastruktur erforderlich, noch müssten Forscher die Systeme kompliziert bedienen, da die Nutzung vollständig in natürlicher Sprache erfolgen kann.

Die Arbeit von Forschern soll dadurch deutlich vereinfacht werden. Bislang mussten Nutzer der LQMs von SandboxAQ eine eigene digitale Infrastruktur bereitstellen, um die Modelle überhaupt ausführen zu können, was zusätzliche Kosten verursachte. Diese Verbindung soll künftig Claude übernehmen. Die Nutzerbasis des Startups bestand bislang überwiegend aus Computer- und Forschungswissenschaftlern oder Experimentalphysikern, die meist bei großen Pharma- oder Industrieunternehmen beschäftigt waren und dort nach neuen Materialien suchten.

Bisherige Lösungen nicht praktikabel

Auch Nadia Harhen, General Manager für KI-Simulation bei SandboxAQ, sieht in der Zusammenarbeit erhebliche Vorteile: „Zum ersten Mal haben wir ein bahnbrechendes Modell auf einem bahnbrechenden LLM, auf das man in natürlicher Sprache zugreifen kann“. Viele Kunden des Unternehmens, das in mehreren Finanzierungsrunden bereits mehr als 950 Millionen US-Dollar von Investoren einsammeln konnte, hätten in der Vergangenheit zahlreiche auf dem Markt verfügbare Software-Lösungen ausprobiert. Aufgrund ihrer hohen Komplexität hätten diese jedoch entweder nicht funktioniert oder keine brauchbaren Ergebnisse geliefert, erklärt Harhen weiter.

Apps & Mobile Entwicklung

Amazon Basics Tastatur im Test

„Tastatur mit DE-Layout, flach, USB-kabelgebunden, Mattschwarz“ lautet die Artikelbezeichnung der „Amazon Basics Tastatur“. Die nüchtern beschreibende Bezeichnung umreißt das zum einstelligen Euro-Kurs erhältliche Eingabegerät treffend. Was es kann, braucht ein paar mehr Worte und einen Test.

Die Amazon Basic Tastatur bietet alle Tasten, ist flach, leise und kostet weniger als 10 Euro. Die Kombination macht sie besonders spannend, denn im Budget-Segment ist die Herausforderung, sehr begrenzte Ressourcen gezielt so zu verteilen, dass am Ende auch ein gut nutzbares Produkt herauskommt. ComputerBase hat sie getestet und stellt fest: Den Anspruch des Basics-Brandings erfüllt die Tastatur nicht.

- Flach

- Wesentliche Medienfunktionen

- klarer Tastendruck

- Geringe Lautstärke

- Grelle Status-LEDs

- Längere Texte anstrengend

Die Basics-Tastatur im Überblick

Die Eigenmarke des Versandhändlers verspricht gute und günstige Produkte, die den alltäglichen Normalo-Bedarf decken, eine Anlaufstelle für ein gesichertes Maß an ordentlicher Qualität sollen sie sein.

Auf dem Papier setzt Amazon die richtigen Prioritäten. Man sieht das am Fehlen von Dingen: Einer (RGB-)Beleuchtung, besonderen Formen, zusätzlichen Tastenkappen oder einer extravaganten Form erteilt das Unternehmen eine Absage. Es ersetzt lediglich Rollen und Co durch Lautstärketasten, lässt das Layout aber unangetastet. Die ersetzten Funktionen liegen zusammen mit Multimedia-Funktionen und einem Shortcut zur Suche auf der Fn-Ebene.

Das macht nicht jeder Hersteller so und selten zum Vorteil, das hat das große Budget-Roundup mit Tastaturen unter 15 Euro schon vor zwölf Jahren gezeigt. Mit einem Preis von knapp unter 10 Euro hat es die Basics-Tastatur aber schwerer. Denn die 10 Euro von damals entsprechen heute rund 12 Euro, ein Unterschied von immerhin 20 Prozent.

Taster: Gummi ist alternativlos

Mechanische Tastentechnik darf für 10 Euro nicht erwartet werden. Erste Einstiegsmodelle mit dieser Technik kosten das Doppelte und sind nicht nur hoch, sondern zudem gut hörbar. Für ein universell brauchbares Basis-Produkt sind alle Mecha-Eigenschaften (Preis, Höhe, Robustheit und Lautstärke) eher ungünstig.

Rubberdome-Technik wird insofern zur logischen Wahl. Sie funktioniert simpel: Beim Eindrücken der Taste wird eine Gummiglocke eingedrückt, die zwei Leiterfolien zusammenpresst und damit einen Kontakt schließt. So wird ein Signal ausgelöst. Im Aufbau und der Fertigung ist diese Technik kostengünstig, aber nicht ewig haltbar, mit Alterung des Gummis verändert sich zudem das Feedback je Taste.

Dazu kommt, dass oft mehrere Tasten gebündelt abgefragt werden. Beim Druck vieler Tasten werden unter Umständen nicht alle korrekt erkannt. Das ist auch bei der Basics-Tastatur der Fall: Garantiert wird nur, dass mindestens 2 Tasten korrekt erkannt werden (2-Key-Rollover). Das klingt am Ende wilder, als es ist, beim Schreiben spielt der Wert keine Rolle, beim Spielen fast nie; spezielle Genres wie Beat-’em-ups vielleicht ausgenommen.

So fühlen sich die Tasten an

Die Amazon-Tasten überzeugen insgesamt nur bedingt. Ihr geringer Hub von 2,5 Millimeter macht Eingaben angenehm, der Druckpunkt ist es weniger. Er entpuppt sich als recht steif, die Tasten müssen mit mehr Kraft betätigt werden und stellen sich etwas behäbig zurück. Das fühlt sich hakelig an und wird bei längerer Nutzung anstrengend.

Um ab und an eine Mail oder eine Rechnung zu schreiben oder sein Passwort irgendwo einzugeben, reicht das Gebotene natürlich, zumal Wenignutzer langsam(er) tippen. Für volle Bürotage reicht es nicht.

Beim Spielen zeigt sich ein ähnliches Bild. In Call of Duty fühlen sich Eingaben an, als würden sie mit etwas Verzögerung laufen, weil man auf die Rückstellung der Taste wartet. Das ärgert schon nach wenigen Minuten.

Es fehlt der Basic-Tastatur am Ende an Geschmeidigkeit, die andere durchaus liefern. Eine Logitech MK950 (Test) zeigt auf, wie es auch dank Scissor-Tastern besser geht. Natürlich: Für eine Office-Tastatur spielt Logitech in der preislichen Oberliga. Aber auch für weniger Geld geht es besser, etwa mit der Logitech K120 für neun Euro, die zwar etwas stärker klappert, aber auch etwas feiner tippt.

Alltag & Akustik

Wenn das Ziel ist, für kleine Ansprüche zu taugen, dann erfüllt Amazon dieses Ziel im Alltag. Der Fokus liegt klar auf Ruhe.

Akustik: Der Aufbau dämpft

Dass die Tastatur ziemlich leise und dumpf agiert, ergibt sich aus ihrer Konstruktion. Flache Tastenkappen, ein flaches Gehäuse und der Umstand, dass Rubberdome-Tastaturen keine großen Schallkörper bilden beziehungsweise ihr Innenleben mit Gummi füllen (müssen), helfen. Eine stabilisierende Metallplatte unter den Folien spart sich die Tastatur, ein wenig Flex hat sie, bleibt aber völlig im Rahmen. Deutliche Nebengeräusche produziert das Basic-Modell dabei nicht, ihr Geräuschpegel lässt sich gut ausblenden. Dabei ist sie durchaus leiser als eine Logitech K120 mit etwas höheren Tastenkappen.

Alltag: Basis beste

Im Alltag punktet das Layout mit der Entscheidung, drei Funktions- durch Lautstärketasten zu ersetzen. Sie haben wenigstens einen praktischen Nutzen. Auch die FN-Ebene positioniert Amazon solide. Das ist bei Budget-Produkten nicht immer die Norm, was auch für die Form der Eingabetaste gilt. Ein internationales Layout oder eines für größere Marktbereiche zu nehmen, kann Kosten senken. So ist alles, was da ist, auch gut nutzbar und ergibt Sinn. Getrübt wird der Glanz von den grellen Status-LEDs. Sie lenken ab und stören nachhaltig.

Fazit

Die Amazon Basic Tastatur bietet alle Tasten, ist flach, leise und kostet weniger als 10 Euro. Die Kombination macht sie besonders spannend, denn im Budget-Segment ist die Herausforderung, sehr begrenzte Ressourcen gezielt so zu verteilen, dass am Ende auch ein gut nutzbares Produkt herauskommt. ComputerBase hat sie getestet und stellt fest: Den Anspruch des Basics-Brandings erfüllt die Tastatur nicht.

Die Tastatur tippt okay, aber nicht in jedem Szenario und mit jedem Nutzer. Sie ist ein „Oma-Produkt“ für den wenig technik-affinen Wenignutzer, der einfach nur möchte, dass Symbole auf dem Bildschirm erscheinen, die langsam nacheinander eingegeben werden. Für den Preis tippt sie im Grunde in Ordnung.

Das ist erst einmal nichts Schlechtes. Man kann diese Basics-Tastatur benutzen, es gibt schließlich noch schlechtere Produkte. Sollte man aber nicht. Der Blick auf Mitbewerber, die ein durchaus feineres, weniger ermüdendes Tippen ermöglichen und nicht mit ihren LEDs blenden, lohnt sich. Die Empfehlung bleibt am Ende die gleiche wie vor 12 Jahren: Für unter zehn Euro kauft man die Logitech K120. Es hat gute Gründe, dass sie seit Ewigkeiten gebaut wird.

- Jetzt die Amazon Basics Tastatur auf Amazon kaufen*

- Jetzt die Logitech K120 Tastatur auf Amazon kaufen*

- Flach

- Wesentliche Medienfunktionen

- klarer Tastendruck

- Geringe Lautstärke

- Grelle Status-LEDs

- Längere Texte anstrengend

ComputerBase hat die Amazon Basics Tastatur für diesen Test auf eigene Kosten im freien Handel erworben.

(*) Bei den mit Sternchen markierten Links handelt es sich um Affiliate-Links. Im Fall einer Bestellung über einen solchen Link wird ComputerBase am Verkaufserlös beteiligt, ohne dass der Preis für den Kunden steigt.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.

Apps & Mobile Entwicklung

Angebliche Intel-Deals: Du bekommst nur alte CPUs, wenn du auch neue nimmst!

Laut einem Medienbericht aus Asien hält Intel einige Hersteller an der kurzen Leine: Alte CPUs gibt es nur, wenn auch neue gekauft werden. Das Vorgehen „Alt+Neu“ ist durchaus nicht neu, in der angespannten Zeit mit extrem hohen Speicherpreisen verdirbt es Kunden aber die Laune. Denn die würden gern mehr älteres Material kaufen.

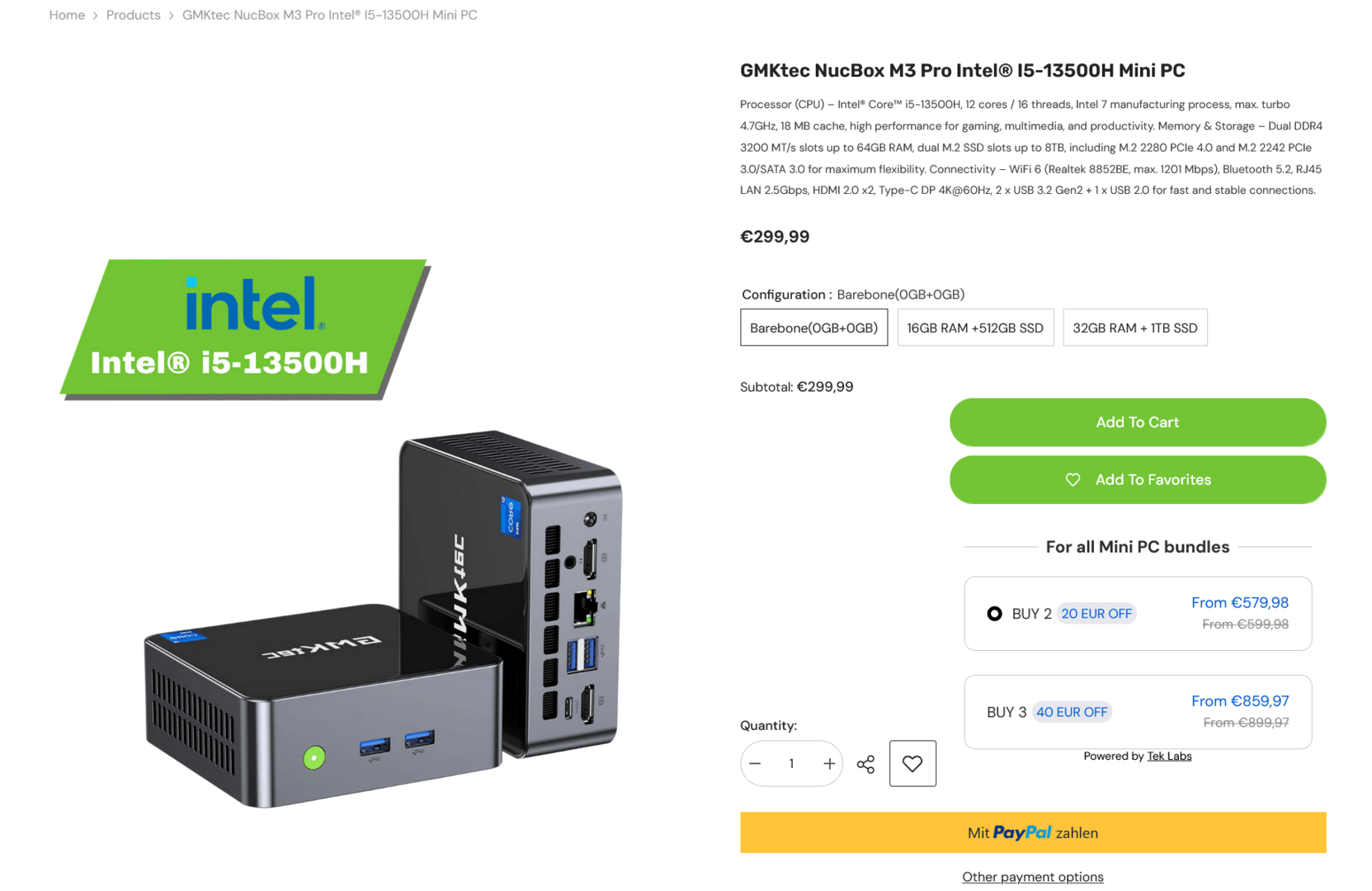

Es war in den letzten Monaten schon oft zu sehen: Plötzlich tauchten beispielsweise bei nahezu jedem Mini-PC-Hersteller aus China Konfigurationen „neu“ wieder auf, die einige Jahre alte Prozessoren von AMD und Intel nutzen, und diese dann am besten auch noch mit älterem DDR4-SODIMM paaren. Hier passt letztlich das Verhältnis aus Preis und Leistung wohl noch am besten, denn sobald es in Richtung DDR5 mit höherem Takt und Kapazität geht, wird es aktuell schnell teurer.

Nikkei berichtet nun von Beschwerden einiger ODMs, die doch eben gern lieber nur solch alte CPUs bei Intel kaufen und entsprechend darauf ihr Geschäft aufbauen wollen. Intel wiederum sagt dies aber angeblich nicht pauschal zu, sondern vereinbart mit den Kunden dann, dass sie auch modernste Intel-18A-Lösungen alias Panther Lake und Wildcat Lake nehmen müssen – sonst gibt es auch keine älteren CPUs.

Intel wiederum schlägt damit zwei Fliegen mit einer Klappe: Ohnehin musste das Unternehmen zuletzt bereits die alte 10-nm-Fertigung für Alder Lake und Raptor Lake sowie für einigen Tiles der Server-CPUs weiter hochfahren, um die Nachfrage nach CPUs überhaupt bedienen zu können. Parallel dazu drückt Intel die neuen Produkte weiter in den Markt, die nun in größeren Volumen zur Verfügung stehen werden. Panther-Lake-Notebooks gibt es nun schon unter 1.000 Euro, mit Intel Wildcat Lake dürfte bei breiter Verfügbarkeit nach der Computex 2026 die 500-Euro-Marke anvisiert werden. Aber auch das ist mitunter zu viel, wie Mini-PCs mit älteren Chips zeigen.

Verlagerung lässt extreme Knappheit entstehen

Der Fokus auf Server-CPUs lässt zudem ohnehin weniger Spielraum für die älteren Consumer-CPUs. Die aktuellen Server-CPUs Intel Granite Rapids setzen auf I/O-Tiles in der älteren 10-nm-Fertigung (Intel 7 genannt), Intel Clearwater Forest wird in den nächsten Wochen starten und ebenfalls diese I/O-Tiles nutzen. Da Server-CPUs aktuell gefragt sind wie nie, ist die Kapazitätsverlagerung dahin folgerichtig. Laut Intels Kunden sei die CPU-Knappheit auch deshalb inzwischen zum Teil schlimmer als bei RAM, denn anders als beim RAM, wo Kapazität und Spezifikation verringert werden kann, gibt es bei einer CPU keine Option.

Im Serverbereich ist Intel in den letzten Jahren am meisten unter Druck geraten, AMD liegt hier in vielen Bereichen nun in Front. Die Umsätze und Gewinne waren deshalb deutlich eingebrochen, erst zuletzt erholten sie sich wieder.

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenMähroboter ohne Begrenzungsdraht für Gärten mit bis zu 300 m²

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateniPhone Fold Leak: Apple spart sich wohl iPad‑Multitasking

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview

-

Künstliche Intelligenzvor 2 Monaten

JBL Bar 1300MK2 im Test: Soundbar mit Dolby Atmos, starkem Bass und Akku‑Rears