Apps & Mobile Entwicklung

AI Glasses: Apples Ray-Ban-Meta-Konter entsteht in Eigenregie

Bereits Ende dieses bis Anfang nächsten Jahres soll Apples Ray-Ban-Meta-Konter auf den Markt kommen – AI Glasses mit integrierter Kamera und Kopfhörern, aber ohne integriertes Display und mit drahtloser Anbindung an ein iPhone. Analog zur Apple Watch soll die smarte Brille vollständig in Eigenregie bei Apple selbst entstehen.

Während Meta bei den eigenen AI Glasses auf Ray-Ban setzt und Google neben Samsung auch Gentle Monster und Warby Parker für die bevorstehenden Android-XR-Brillen ins Boot geholt hat, will Apple das Projekt in Eigenregie umsetzen, berichtet Bloomberg. Das erinnert an die Apple Watch, die mit Ausnahme ausgewählter Hermès- und Nike-Produkte ebenfalls vollständig aus Apples Feder stammt. Gehäuse, Farben, Zifferblätter, Armbänder – Apple kooperiert dafür nicht mit einem Uhrenhersteller.

Apple experimentiere mit vier Designs

Apples Designteam habe bislang mindestens vier Designs entworfen, so Bloomberg, hinzu kommen mehrere Farboptionen. Schwarz, Ozeanblau und Hellbraun werden in dem Bericht genannt. Erarbeitet werde ein Design, das unmittelbar erkennbar sei. Intern genutzte Modelle fertige Apple aus hochwertigem Acetat. Mit vier Varianten experimentiere Apple zurzeit:

- Ein großes rechteckiges Modell im Stil der Ray-Ban Wayfarer

- Eine schmale rechteckige Variante ähnlich der Brille von CEO Tim Cook

- Eine größere Brille mit ovalen oder runden Gläsern

- Ein kleineres Modell mit ovalen oder runden Gläsern

Kameras in ovaler Form

Absetzen von den Meta-Brillen sollen sich Apples Modelle auch über das Design der Kameras. Senkrecht platzierte ovale Linsen sollen sich von Metas runder Umsetzung unterscheiden. Über die Kamera nimmt die Brille die Umgebung des Trägers wahr und kann darauf basierend „Visuelle Intelligenz“ ausführen, genauere Navigationshinweise in Apple Maps geben oder Erinnerungen anhand des Standortes und Gebäudes auslösen. Die neue Siri im geplanten iOS 27 soll ebenfalls eine wichtige Rolle spielen.

Vollwertige AR-Brille noch Jahre entfernt

Eine vollwertige, leichte AR-Brille mit transparenten Displays liege hingegen noch in weiter Ferne, so Bloomberg. Dem Bericht zufolge sei damit nicht vor Ende der aktuellen Dekade zu rechnen.

Faltbares iPhone liegt im Zeitplan

Von Apples AR-Ambitionen abgesehen, geht Bloomberg auch noch einmal auf Apples erstes faltbares Smartphone ein, das entgegen einem Bericht aus Japan voll im Zeitplan liege. Das iPhone Foldable soll in der ersten Septemberhälfte gemeinsam mit dem iPhone 18 Pro und iPhone 18 Pro Max angekündigt werden und auch zum selben oder annähernd selben Zeitpunkt in den Verkauf gehen.

Apps & Mobile Entwicklung

CoWoS-Nachfolger kommt später: TSMCs Pilotlinie für CoPoS wird erst 2028 fertig – für Produkte in 2030+

TSMC bestätigte erstmals, eine Pilotlinie für CoPoS als neuen Packaging-Standard zu bauen. Aber bis zur Markteinführung wird es lange dauern, womit das Unternehmen auch Gerüchten begegnet, die zuletzt eine schnelle Adaption durch Nvidia vermutet hatten. Zwischen Wunsch und Realität liegen demnach wohl doch gewaltige Aufgaben.

CoWoS steht für „Chips on Wafer on Substrat“. Es ist die aktuelle Packaging-Technologie von TSMC, mit denen Nvidia, AMD und viele weitere Firmen, beispielsweise GPU-Dies zusammen mit HBM auf einem Package vereinen und so erst den nutzbaren KI-Beschleuniger hervorbringen. CoWoS hat dabei schon einige Entwicklungsstufen durchgemacht und ist stetig gewachsen, sprich der Interposer ist größer geworden, um noch mehr Chips aufzunehmen

Doch der Ruf nach noch mehr Leistung braucht nun neue Ansätze. Diese suchen die Unternehmen gemeinsam auch beim Packaging. TSMC brachte unter anderem SoW-X ins Spiel, ein System auf einem Wafer. Für gewisse Zwecke funktioniert das auch, an einem klassischen rechteckigen oder quadratischen Substrat scheint in Zukunft aber dennoch kein Vorbeikommen zu sein. Die nächste Stufe heißt deshalb CoPoS.

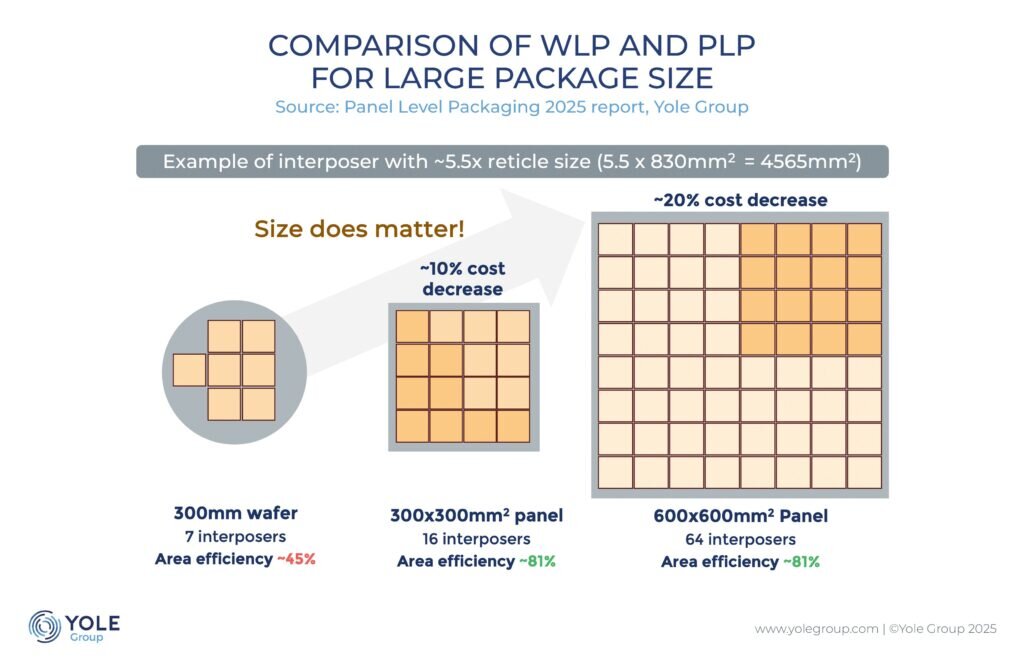

CoPoS steht für „Chips on Panel on Substrat“. Panel bezieht sich in dem Fall auf die Fertigung der passenden und viel größeren Substrate, die nun nicht mehr von einem runden Wafer bezogen werden, sondern einem rechteckigen Panel. Auch in anderen Bereichen soll das Panel-level Packaging (PLP) gegenüber dem Wafer-level Packaging (WLP) in Zukunft an manchen Stellen Vorrang erhalten, es verspricht nämlich eine höhere Wirtschaftlichkeit – unter anderem beim zukünftigen Glas-Substrat. Dort war bereits von Größen bis zu 600 × 600 mm die Rede, CoPoS geht also in eine ähnliche Richtung.

TSMC bestätigt CoPoS-Entwicklung mit langen Zeiten

Im Rahmen des Quartalsberichts bestätigte TSMC erstmals ganz öffentlich eine Produktionslinie für CoPoS zu bauen. Damit fängt das Unternehmen aber erst im zweiten Halbjahr dieses Jahres an, im kommenden Jahr soll die Einrichtung dann ausgerüstet werden und die Erprobung beginnen. Das Ziel ist es, diese eventuell ab 2028 dann in den Status „Bereit zur Serienproduktion“ überführen zu können. Dafür würde aber eine echte Packaging-Fabrik ausgerüstet werden müssen, ein Start in Serie wäre so frühestens ab Ende 2029 absehbar, mit Produkten für das Jahr 2030. Und all dies würde vor allem gegenüber CoWoS auf so vergleichbar winzigem Niveau passieren, dass es zu Beginn ein echtes Nischenprodukt ist und auch noch längere Zeit bleibt.

Zuvor muss dabei aber auch ersten Problemen begegnet werden, denn die Umsetzung für eine Großserie scheint demnach nicht so leicht zu sein, berichtet DigiTimes aus Asien dazu. Die größeren Chips/Packages haben demnach Probleme mit „uniformity“ und „warpage“ – exakt dies wurde unter anderem aber auch schon als Grund bei Nvidias riesigem Rubin-Ultra-Die genannt, sodass es hier eventuell ein neues Packaging braucht.

An CoWoS ist deshalb wohl im nächsten Jahrzehnt kaum ein vorbeikommen – für die nächsten zwei Jahre ist es aber schon wieder nahezu ausgebucht, also so, wie die letzten fünf Jahre bereits. Die nächste Stufe umfasst weitere Verbesserungen, ein mittels SoIC gestapelte Chip wie beispielsweise ein Ryzen X3D kann nun auch noch mittels CoWoS auf einem Interposer platziert werden. Dies eröffnet neue Möglichkeiten für kommende Generationen an Chips. In der kommenden Woche beim TSMC Technology Symposium 2026 dürfte das Unternehmen auch diesen Punkt als Thema eröffnen.

Apps & Mobile Entwicklung

AMD-Aktie auf Rekordniveau: Angebliche Instinct-MI450-Nutzung bei Anthropic beflügelt

Anthropic sucht per Stellenausschreibung Personal, dass sich neben Nvidias CUDA auch mit ROCm auskennt, also dem AMD-Gegenstück von CUDA. Dieses eine Wort und weitere, zum Teil darauf basierende Gerüchte haben gereicht, dass AMDs Aktie an der Börse reagiert und zum Rekord angesetzt hat.

In der schnelllebigen AI-Zeit kann schon ein Gerücht für deutliche Aktienbewegungen sorgen. Zuletzt schaffte das die Meldung, dass Nvidia einen PC-Hersteller übernehmen könnte. Nun war AMD an der Reihe, diesmal gepaart mit der Meldung, dass Instinct MI450 bei Anthropic unterkommen könnten. Da dieses Gerücht nahezu parallel zur Stellenausschreibung aufkam, ging es für die Aktie entsprechend aufwärts, die erstmals bei über 278 US-Dollar lag.

Rückhalt bekommt der gute Ausblick bei AMD aber auch durch die bereits in dieser Woche veröffentlichten Quartalsberichte von ASML und den sehr guten Zahlen von TSMC. Denn beide sehen kein Ende des KI-Booms, im Gegenteil. Die Aussichten der Unternehmen, die für die Fertigung der Chips von AMD & Co nötig sind, sehen sehr gut aus, was darauf hindeutet, dass die Kundschaft eine entsprechende Nachfrage geäußert hat.

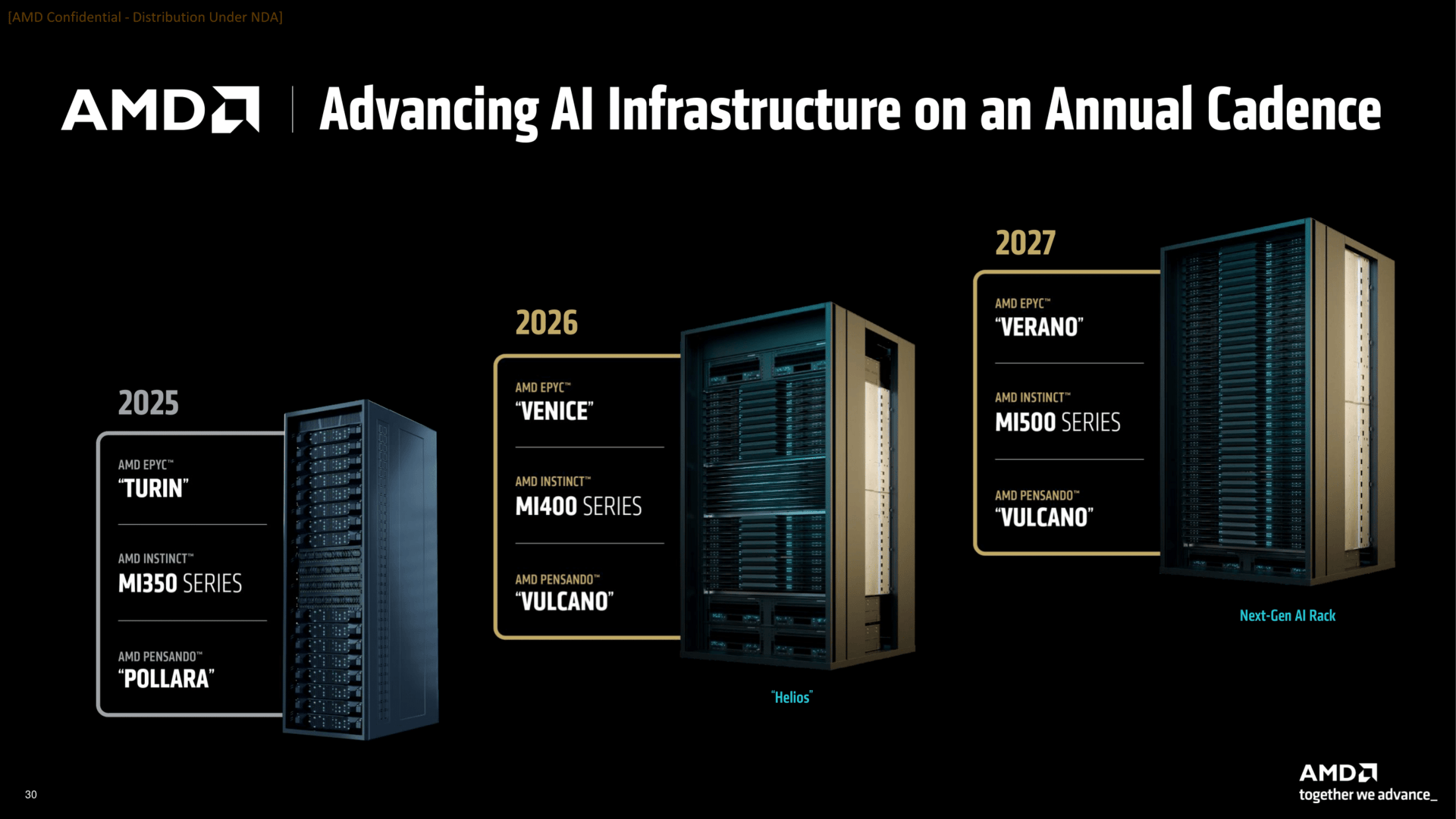

Bei AMD beginnt in diesem Jahr das Zeitalter der Rackscale-Architektur. Helios ist die erste Verschmelzung von Zen-6-Venice-Server-Prozessoren mit Instinct-MI450-AI-Beschleunigern in einem großen Rack. In schneller Folge sollen in den kommenden Jahren weitere Produkte folgen. MI500 mit noch mehr HBM4e und einem darauf angepassten Prozessor Verano – hier erstmals mit von AMD kürzlich bestätigtem SOCAMM2-Speicher – soll neben der Leistung auch die Effizienz im Fokus haben.

Bei Anthropic dürfte auch das Helios-Rack im Gespräch sein, da es explizit auf Hyperscaler und AI ausgelegt ist. Pro Rack kommen 72 MI455X zum Einsatz, die für 2,9 ExaFLOPS an KI-Leistung sorgen sollen. Die Epyc-Prozessoren der nächsten Generation kommen zusammen auf 4.600 Kerne und die 31 TB an HBM4 sollen vereint für 43 TB/s Durchsatz sorgen. Die offizielle Vorstellung dieser Systeme und aller Bauteile wird im Rahmen des Events AMD Advancing AI 2026 ab 22. Juli erwartet.

Apps & Mobile Entwicklung

DeepL: Echtzeit-Sprachübersetzung mit Voice-to-Voice nun Realität

Das KI-Übersetzungstool DeepL hat mit DeepL Voice-to-Voice eine neue Produktreihe vorgestellt, die eine Sprachübersetzung in Echtzeit per mündlicher Kommunikation ermöglicht. Der Einsatz ist insbesondere in virtuellen Meetings vorgesehen, sodass Teams weltweit mühelos über Sprachbarrieren hinweg zusammenarbeiten können sollen.

Kommunikation ohne menschlichen Übersetzer

Gespräche in unterschiedlichen Sprachen sollen damit künftig vollständig ohne Dolmetscher auskommen. DeepL Voice-to-Voice ermöglicht es, ganz natürlich in der eigenen Sprache zu sprechen, während das Gesagte beim Empfänger präzise übersetzt wird. Laut CEO Jarek Kutylowski kombiniert DeepL hierfür die bekannten eigenen Sprachmodelle mit der ebenfalls eigenen, bewährten KI-Übersetzungstechnologie, um insbesondere Unternehmen eine barrierefreie Kommunikation zu ermöglichen.

Die neue Technologie fußt dabei auf fünf zentralen Eckpfeilern:

- Voice for Meetings soll eine Echtzeit-Übersetzung auf Plattformen wie Microsoft Teams und Zoom ermöglichen, wobei Teilnehmer in ihrer Muttersprache sprechen, während die Empfänger die Inhalte in ihrer jeweils gewählten Sprache hören. Das Early-Access-Programm soll im Juni dieses Jahres starten, eine Registrierung ist ab sofort möglich.

- Voice for Conversations richtet sich primär an den mobilen Einsatz, geht jedoch darüber hinaus und soll eine plattformübergreifende Übersetzung bieten, insbesondere für Szenarien, in denen die Installation von Apps nicht praktikabel oder zulässig ist.

- Mit Gruppenkonversationen will DeepL den mehrsprachigen Austausch in Trainings, Coachings und Workshops erleichtern, indem Teilnehmer per QR-Code direkt dem Gespräch beitreten und dank Multi-Device-Zugang gleichzeitig Echtzeit-Übersetzungen empfangen können. Diese Funktion soll ab dem 30. April verfügbar sein.

- Darüber hinaus ermöglicht die Voice-to-Voice-API Unternehmen, die Sprachübersetzung direkt in interne Anwendungen sowie kundenorientierte Tools zu integrieren; hier hat das Early-Access-Programm bereits begonnen, eine Registrierung ist weiterhin möglich.

- Ergänzend sollen neue Optimierungsfunktionen sicherstellen, dass spezifische Terminologie wie Branchenbegriffe, Produktnamen oder Eigennamen auch bei schneller oder technischer Sprache präzise erkannt und entsprechend verarbeitet, also bei Bedarf nicht übersetzt werden. Bestehende DeepL-Glossare werden dafür in DeepL Voice integriert, um eine einheitliche Terminologie über alle Gespräche hinweg zu gewährleisten. Diese Funktion soll ab dem 7. Mai verfügbar sein.

Großes Sprachpaket bereits zum Start vorhanden

DeepL richtet die neue Technologie auch auf eine einfache Zugänglichkeit für kleinere Teams aus. Das Self-Service-Modell erlaubt es Unternehmen, die Lösung im Rahmen eines kostenlosen Testzeitraums unmittelbar zu implementieren und zu erproben, bevor der Einsatz ausgeweitet wird. Zum Start von Voice-to-Voice wird bereits eine breite Auswahl an Sprachen unterstützt, darunter alle 24 offiziellen EU-Sprachen sowie Arabisch, Bengalisch, Hebräisch, Norwegisch, Tagalog, Thailändisch und Vietnamesisch. Insgesamt soll DeepL Voice zum Start mehr als 40 Sprachen abdecken.

DeepL will komplette Infrastruktur für Übersetzungen erschaffen

Parallel zum Launch von Voice-to-Voice entwickelt DeepL sein Kernprodukt, das nach eigenen Angaben weltweit von über 200.000 Teams sowie Millionen von Einzelnutzern genutzt wird, zur nächsten Generation der Übersetzungsplattform weiter. Ziel ist der Aufbau einer End-to-End-Übersetzungsinfrastruktur für moderne Unternehmen. Damit sollen Ineffizienzen klassischer Übersetzungsmanagements beseitigt werden, die nach Ansicht des Unternehmens häufig auf langsamen, starren und manuellen Prozessen beruhen und entsprechend hohe Kosten verursachen. „Globale Unternehmen haben heute kein reines Übersetzungsproblem mehr; sie haben ein strukturelles Problem im Betriebsablauf. Heutige Sprachlösungen lassen sich oft nicht schnell genug skalieren und bremsen so das Wachstum“, erklärt Jarek Kutylowski das Vorhaben.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 3 Monaten

UX/UI & Webdesignvor 3 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Entwicklung & Codevor 1 Monat

Entwicklung & Codevor 1 MonatCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenInterview: Massiver Anstieg der AU‑Fälle nicht durch die Telefon‑AU erklärbar

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Entwicklung & Codevor 3 Monaten

Entwicklung & Codevor 3 MonatenKommentar: Entwickler, wacht auf – oder verliert euren Job