Apps & Mobile Entwicklung

Gemini für Chrome: Google integriert seine KI noch stärker in Android

Im Rahmen der diesjährigen „The Android Show“, die als Auftakt zur in der kommenden Woche startenden „Google I/O“ dient, hat Google zahlreiche Neuerungen für Android vorgestellt. Dazu zählt unter anderem ein neuer Browser-Assistent auf Basis von Gemini 3.1, der Nutzern künftig zahlreiche Aufgaben direkt im Browser abnehmen soll.

Mit den angekündigten Neuerungen treibt Google die tiefere Integration seines KI-Modells in Android sowie den Ausbau der KI-Funktionen in Chrome weiter voran. Vor allem Auto Browse soll dabei für eine intelligentere Unterstützung und stärkeres agentisches Browsen direkt auf dem Smartphone sorgen.

Gemini wird zum Browser-Assistenten auf Android

Unter Android soll Gemini künftig direkt in Chrome als persönlicher KI-Browser-Assistent fungieren und das mobile Surfen erweitern. Die KI soll dabei Websites nicht nur darstellen, sondern deren Inhalte auch verstehen und interpretieren können. Der Assistent soll sich öffnen lassen, ohne die aktuelle Seite oder die Anwendung verlassen zu müssen. Dadurch können Anwender Fragen zur geöffneten Seite stellen, längere Artikel zusammenfassen lassen oder zusätzliche Erklärungen zu komplexeren Themen abrufen.

Google verknüpft den Assistenten stärker mit eigenen Diensten

Google betrachtet Gemini schon seit Längerem nicht mehr als reinen Assistenten für einfache Aufgaben. Künftig soll die KI deutlich tiefer in die eigenen Dienste eingebunden werden und sich innerhalb von Chrome zunehmend zu einem Produktivitätswerkzeug entwickeln. Als Beispiele nennt Google nicht nur das automatische Eintragen von Terminen in den Kalender, sondern auch das Ablegen von Zutaten aus Rezepten in den Notizen oder das Auffinden bestimmter Informationen in Gmail.

Die neuen Funktionen positioniert Google als kontextbezogene Unterstützung, die Anwender organisierter und effizienter arbeiten lassen sollen, dabei aber weiterhin die Privatsphäre respektieren und die Kontrolle beim Nutzer belassen sollen.

Wird zusätzlich die Funktion Personal Intelligence aktiviert, erweitert sich der verfügbare Kontext nochmals deutlich. Dann können auch Interessen, Hobbys sowie Informationen über Familie oder, wie Google hervorhebt, auch Haustiere in die Antworten einfließen. Das Unternehmen betont in diesem Zusammenhang die erweiterten Kontrollmöglichkeiten, mit denen Nutzer selbst festlegen können, wie viele persönliche Informationen Gemini als Kontext verwenden darf.

Nano Banana kann auf Android nun Bilder direkt in Chrome anpassen

Auch bei der Bildbearbeitung erweitert Google die KI-Funktionen in Chrome für Android. Mithilfe des Bildgenerators Nano Banana sollen Anwender Inhalte künftig stärker personalisieren oder im Web gefundene Bilder direkt im Browser bearbeiten können. Google nennt als Beispiel eine Lernsituation, in der der Inhalt einer Website per einfacher Anweisung in eine visuelle Darstellung umgewandelt wird.

Ein weiteres Beispiel betrifft Wohnungsanzeigen, deren Bilder mit zusätzlichen Einrichtungsgegenständen ergänzt werden können, um besser einschätzen zu können, wie die Räume möbliert wirken. Google will Bildgenerierung und Bildbearbeitung künftig deutlich stärker in den alltäglichen Browser-Kontext integrieren.

Auto Browse soll alltägliche Aufgaben stärker automatisieren

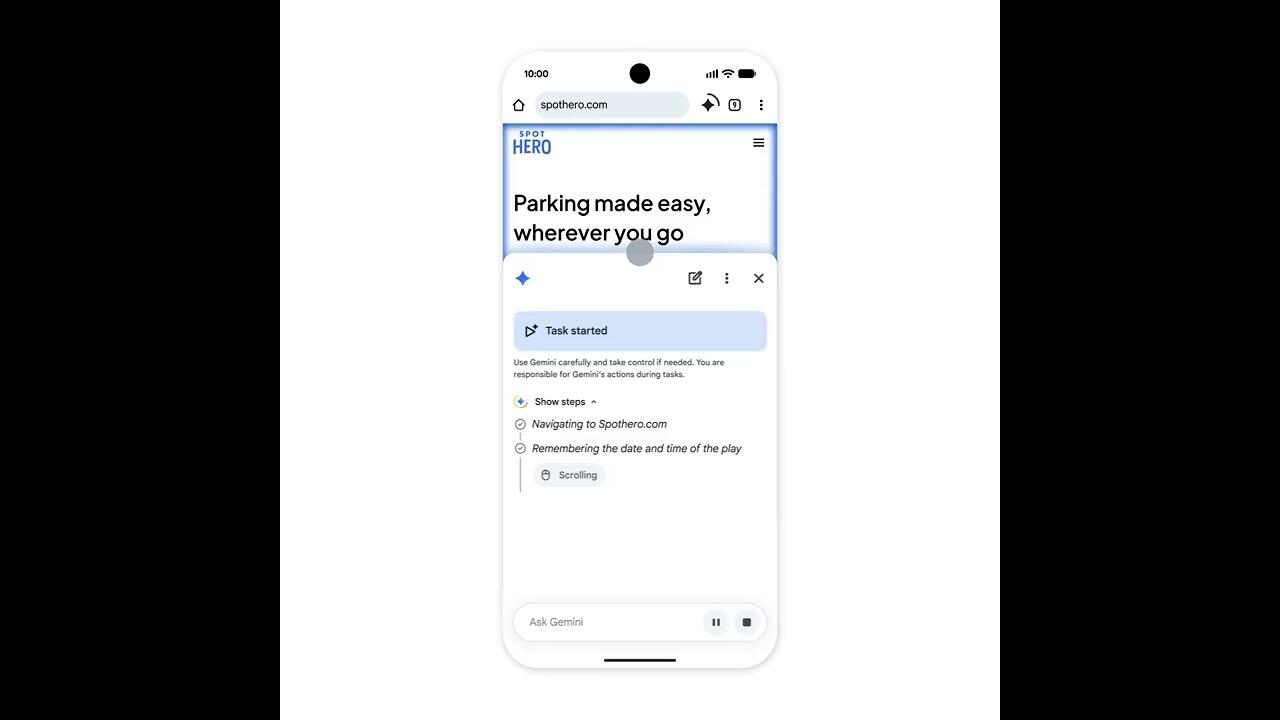

Bei Auto Browse handelt es sich um eine Anfang 2026 eingeführte KI-Funktion für Chrome, die als autonomer Agent arbeitet. Sie soll Aufgaben im Internet selbstständig übernehmen, für die bislang manuelle Eingaben erforderlich waren. Durch die Integration in Android soll das System künftig auch auf Smartphones zahlreiche wiederkehrende Aufgaben automatisieren können. Dazu zählen unter anderem das Ausfüllen von Formularen mit Standardangaben oder regelmäßig wiederkehrende Bestellvorgänge. Aber auch das Suchen eines Parkplatzes bei Veranstaltungen wird von Google als Beispiel angegeben.

Ebenso sollen Informationen aus anderen Inhalten automatisch für bestimmte Aufgaben übernommen werden können. Mit diesen Funktionen geht Google inzwischen deutlich über klassische Assistenzsysteme hinaus und entwickelt Chrome stärker in Richtung eines agentischen Browsers, der nicht mehr nur Informationen liefert, sondern selbstständig Aktionen auf Webseiten ausführen kann.

Sicherheitsmechanismen sollen sensible Aktionen absichern

Im Rahmen der Vorstellung betonte Google, dass die neuen Funktionen mit denselben Sicherheitsmechanismen ausgestattet seien, die bereits aus der Desktop-Version bekannt sind. Diese sollen unter anderem vor Angriffen wie Prompt Injections schützen. Zusätzlich integriert Google bei bestimmten Funktionen weitere Sicherheitsabfragen. So soll Auto Browse vor sensiblen Aktionen ausdrücklich eine Bestätigung anfordern. Das betrifft beispielsweise Käufe oder Veröffentlichungen in sozialen Netzwerken. Gerade beim agentischen Browsen sieht Google diesen Schritt als entscheidend an, da der Browser künftig immer häufiger eigenständig Handlungen im Auftrag des Nutzers ausführen soll.

Start zunächst in den USA

Google will Gemini in Chrome ab Ende Juni zunächst in den USA auf ausgewählten Geräten mit Android 12 und neuer bereitstellen. Gleichzeitig soll Auto Browse für AI-Pro- und Ultra-Abonnenten unter denselben Voraussetzungen starten. Zudem kündigte Google an, zahlenden Abonnenten beim Zugriff auf die neuen KI-Funktionen Vorrang einzuräumen.

ComputerBase hat Informationen zu diesem Artikel von Google unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Agentisches Betriebssystem: So sichert Google Gemini Intelligence und Android ab

Der Einzug von Gemini Intelligence in Android 17 macht das Betriebssystem teils agentisch, da Agenten jetzt eigenständig für den Anwender Aufgaben erledigen können. Zu diesem Zweck führt Google neue Sicherheitsmechanismen und Berechtigungen ein. Die Android-Sicherheit wird auch an mehreren anderen Stellen von Google aufgerüstet.

Android steuert einer agentischen Zukunft entgegen

Die „agentische Zukunft von Android“, wie Google die aktuelle Ankündigung betitelt, geht mit erweiterten Steuerungsfunktionen für den Anwender einher, da dieser der neuen Automatisierung über unterschiedlichste Apps hinweg erst zustimmen muss. Google erklärt auch, dass Gemini Intelligence mit drei Grundprinzipien einhergehe: expliziter Nutzerkontrolle, umfassendem Datenschutz und operativer Transparenz.

Was ist ein Agent?

Aber was ist eigentlich ein KI-Agent? Ein KI-Agent ist ein Programm mit künstlicher Intelligenz, das selbstständig Aufgaben ausführen kann. Anders als ein normaler Chatbot reagiert ein KI-Agent nicht nur auf einzelne Fragen, sondern kann Ziele verfolgen, Informationen sammeln, Entscheidungen treffen und Aktionen ausführen – zum Beispiel Termine planen, E-Mails beantworten oder Daten analysieren. Er ermöglicht demnach eine Automatisierung. Dabei nutzt er oft Sprachmodelle, Werkzeuge und Zugriff auf andere Programme, um Probleme möglichst eigenständig zu lösen. Er wird „Agent“ genannt, weil er ähnlich wie ein menschlicher Assistent eigenständig handelt: Er nimmt Informationen wahr, verfolgt ein Ziel und führt passende Aktionen aus, statt nur auf einzelne Befehle zu reagieren.

Die Automatisierung muss freigegeben werden

Die Befähigung von Agenten und deren automatisierten Prozessen verlangt eine neue Nutzerkontrolle, da nun Agenten und nicht nur der Nutzer selbst Apps ausführen kann. Zunächst einmal erklärt das Unternehmen, dass Nutzer granulare Kontrolle über die einzelnen Funktionen erhalten und jederzeit gesamte Features oder einzelne Komponenten per Opt-in und Opt-out aktivieren respektive deaktivieren können.

Ein Beispiel: Die Verknüpfung von Gemini mit „Autofill with Google“ ist ein expliziter Opt-in, der vorab erfolgen muss. Diese Verbindung lässt sich im Nachgang über die Einstellungen auch wieder auflösen. Die Steuerung der Gemini-App-Automatisierung für spezifische Apps soll laut Google aber erst „later this year“ nachgereicht werden.

Zur neuen Nutzerkontrolle zählen auch „Leitschienen“, sodass Gemini Aufgaben erst dann automatisieren kann, wenn der Assistent explizit vom Nutzer für diese Aufgabe beauftragt wurde. Gemini erhält laut Google ausschließlich Zugang zu Apps, die vom Anwender dafür freigegeben wurden – und nicht das gesamte Gerät. Gemini agiert zudem so, dass vor automatisierten Einkäufen immer zunächst noch eine Nutzerabfrage erfolgt.

Ob persönliche Daten mit einer App oder Gemini geteilt werden dürfen, liegt ebenfalls in der Hand des Nutzers. Dafür erscheint sowohl bei selbst ausgeführten Aktionen wie der Beauftragung von Gemini für eine neue Automatisierung als auch bei vom Betriebssystem selbst ausgeführten Aktionen wie Magic Cue (nicht in Deutschland verfügbar) ein Hinweisbildschirm mit Abfrage der benötigten Berechtigungen.

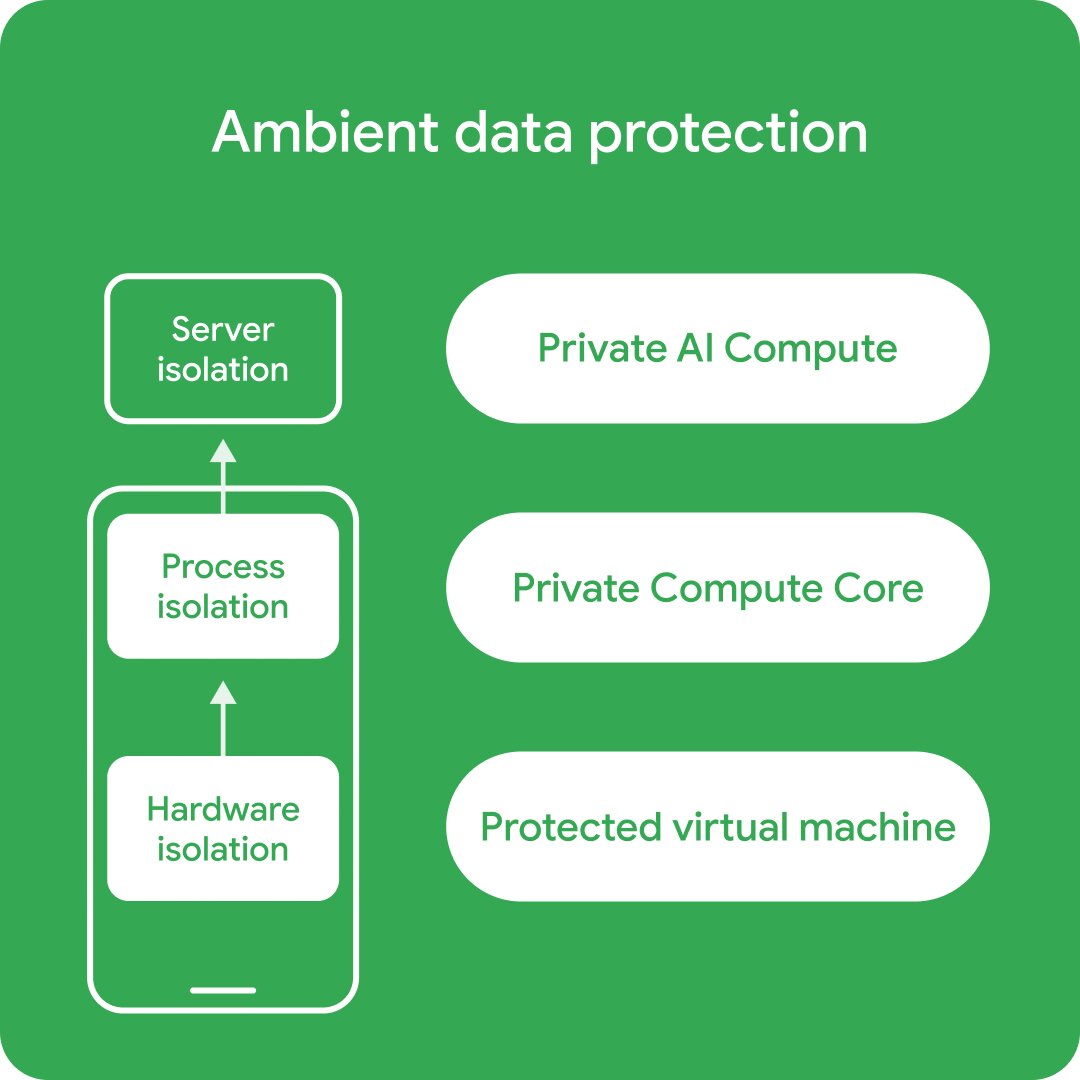

Automatisierte Prozesse werden isoliert ausgeführt

Features wie Magic Cue will Google mit einem umfassenden Datenschutz über den Private Compute Core, Private AI Compute und Protected KVM absichern. Google spricht zudem von einer „bewährten Architektur“, die auch andere Google-Produkte von Milliarden Nutzern absichere. Automatisierte Vorgänge liefen zudem in einem isolierten Prozess, erklärt Google, um zum Beispiel Angriffe wie Prompt Injection abzuwehren.

Unter der operativen Transparenz versteht Google neue Anzeigen im Betriebssystem, wenn automatisierte Prozesse ausgeführt werden. Dazu gehören auch Aktivitätslogs im Privacy Dashboard von Android. Wenn Gemini etwas eigenständig über mehrere Apps hinweg ausführt, lassen sich die Schritte in Echtzeit über die Schaltfläche „View progress“ überwachen. Sollten Nutzer diese Benutzeroberfläche verlassen, bleibt dennoch eine Benachrichtigung über den laufenden Prozess am oberen Bildschirmrand erhalten. Wird die neue Rambler-Funktion genutzt, wird auch das hervorgehoben.

Google will im Android Privacy Dashboard außerdem anzeigen, welche Aktionen ein KI-Assistent für den Anwender ausgeführt hat und in welchen Anwendungen dieser über die letzten 24 Stunden aktiv war. Diese Feature soll „bald“ nachgereicht werden.

Google liefere des Weiteren prüffähigen Code, was für zusätzliche Transparenz sorgen soll. Schlüsselfunktionen von Googles AI-Sicherheitsarchitektur seien open source, binärtransparent und würden von externen Experten (PDF) überprüft.

Neue Android-Sicherheitsfeatures im Überblick

Abseits der agentischen Fähigkeiten will Google die Sicherheit auch an mehreren anderen Stellen aufrüsten, um beispielsweise Betrug zu unterbinden.

Bankbetrug und Scam-Anrufe unterbinden

Dafür arbeitet Google unter anderem mit Banken zusammen, um (erfolgreiche) Scam-Anrufe und finanzielle Schäden zu verhindern. Das funktioniert, wenn die entsprechende Banking-App installiert und der Nutzer eingeloggt ist. Die Absicherung soll „in den kommenden Wochen“ ab Android 11 zuerst für Revolut, Itaú und Nubank eingeführt werden. Angeblich von der Bank stammende Anrufe muss der Nutzer dann in der App bestätigen. Erklärt die Banking-App, dass es keinen offiziellen Anruf gibt, wird der Anruf sofort beendet. Die Banken können zudem Rufnummern festlegen, die zwar offiziell genutzt werden (etwa intern), über die aber niemals Kunden angerufen werden. Auch dann werden Anrufe sofort beendet.

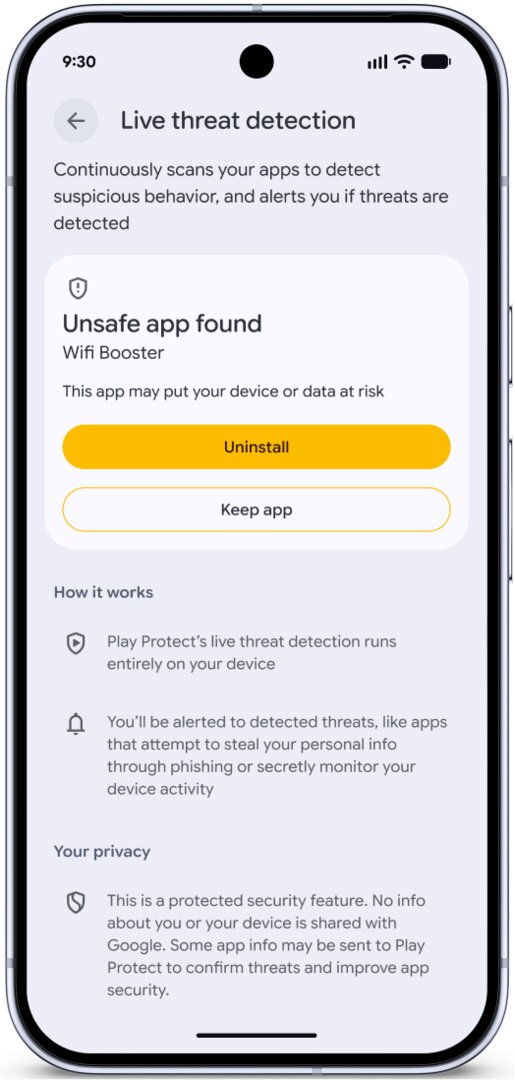

Betrug soll auch an anderer Stelle verhindert werden, etwa bei verdächtig handelnden Apps. Google will zum Beispiel die SMS-Weiterleitung durch eine App an eine andere Nummer und damit die Weitergabe von Einmalpasswörtern unterbinden. Auch die missbräuchliche Nutzung von Features der Barrierefreiheit soll ausgeschlossen werden. Das „Dynamic Signal Monitoring“ soll in Echtzeit Apps überwachen und verdächtige Aktionen vereiteln, indem überwacht wird, ob Apps ungewöhnliche Aktionen ausführen, etwa wenn sie ihr Logo ändern oder verstecken und dann im Hintergrund agieren. Dynamic Signal Monitoring soll ab Android 17 im zweiten Halbjahr aktiviert werden.

Chrome prüft APK-Dateien vor dem Download

Da unter Android auch Apps aus externen Quellen und manuell über heruntergeladene APK-Dateien installiert werden können, führt Google als Bestandteil von Safe Browsing für Chrome einen Schutz ein, der Dateien noch vor dem Download prüfen kann.

Advanced Protection jetzt mit USB-Schutz

Google bietet mit der Advanced Protection zudem ein Gegenstück zum Blockierungsmodus in iOS, der bei Personen, die aufgrund ihrer Identität oder Tätigkeit möglicherweise ins Visier besonders ausgefeilter digitaler Bedrohungen geraten können, zusätzliche Schutzmaßnahmen zur Verfügung stellt.

Bei der Advanced Protection ist ab Android 16 jetzt standardmäßig der USB-Schutz gegen Angriffe über die physische Schnittstelle aktiv. Ab Android 17 wird zudem allen Apps der Zugriff auf die Barrierefreiheit-Services entzogen, sofern es sich nicht explizit um Barrierefreiheit-Tools handelt. Das Entsperren über ein anderes Gerät und Chrome WebGPU deaktiviert Google ebenfalls, wenn die Advanced Protection aktiv ist, zudem werden Chat-Benachrichtigungen auf potenzielle Scams untersucht. Später im Jahr soll Android Protection erstmals auch für Android Enterprise zur Verfügung stehen.

Aktiver Diebstahlschutz für Risikoländer

Den Gerätediebstahl will Google mit der biometrischen Absicherung über den Find Hub weiter erschweren, sodass ein verlorenes oder gestohlenes Smartphone neben Passwort und PIN auch über ein biometrisches Anmeldeverfahren gesperrt werden kann. Wird im Find Hub ein Gerät als verloren gemeldet, werden daraufhin die Schnelleinstellungen sowie neue Wi-Fi- und Bluetooth-Verbindungen gesperrt.

Nach einer Pilotphase in Brasilien ist der Android-Diebstahlschutz fortan standardmäßig für mehr Nutzer von Haus aus aktiviert, darunter alle neu ausgelieferten Android-17-Geräte sowie diejenigen, die auf Android 17 aktualisiert oder mit Android 17 zurückgesetzt wurden. In Argentinien, Chile, Kolumbien, Mexiko und dem Vereinigten Königreich ist der Diebstahlschutz jetzt sogar standardmäßig ab Android 10 aktiviert. Außerdem reduziert Google die Anzahl der Eingabeversuche bei Passwort und PIN und verlängert die Zeit zwischen den Versuchen. Darüber hinaus lässt sich die IMEI auf Geräten mit Android 12 und neuer jetzt über den Sperrbildschirm einsehen, was Ermittlungsbehörden, Geräteherstellern und Netzbetreibern bei der Identifizierung helfen soll. Dieses Merkmal lässt sich in den Einstellungen deaktivieren.

Einmalige genaue Standortbestimmung für Apps

Die genaue (statt ungefähre) Standortbestimmung des Nutzers lässt sich innerhalb von Apps jetzt auch einmalig explizit für eine Anfrage freigeben. Wie bei Kamera und Mikrofon gibt es bei der aktiven Standortbestimmung einen neuen Indikator in der Statusleiste, über den sich auch die letzten Zugriffe durch Apps einsehen und einschränken lassen. Einer App lässt sich neuerdings zudem eingeschränkter Zugriff auf einzelne Kontakte geben, anstatt der App Zugriff auf alle Kontakt zu erteilen.

Android OS Verification gegen gefälschte GMS

Explizit für Pixel-Geräte ist die „Android OS Verification“ ab Android 17, die die Installation gefälschter Android GMS (Google Mobile Services) abfangen soll. Google will über die eigenen Google-Apps öffentlich Buch führen und damit einen kryptografischen Beweis liefern, dass es sich um authentische Google-Apps und GMS-APIs handelt. Auf Pixel-Geräten arbeite dies Hand in Hand mit der Pixel System Image Transparency.

Nutzung von 2G-Netz unterbinden

Einmalpasswörter (OTP), die als Textnachricht auf dem Gerät eingehen, versteckt Android fortan für drei Stunden von den meisten Apps, damit diese nicht abgegriffen werden können. Android 17 bietet zudem einen Schalter, um das altgediente, unsichere 2G-Netz nicht mehr zu nutzen. Bei Geräten von einem Netzbetreiber kann dieses Feature auch von Haus aus aktiviert sein, sodass etwa lediglich noch 4G und 5G aktiv sind.

ComputerBase hat Informationen zu diesem Artikel von Google unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Googlebook: Googles neue Notebook-Kategorie mit Android Tech Stack

Google erweitert das Feld der Chromebooks um eine neue Kategorie, die sie mit Android verschmelzen und Gemini Intelligence ins Zentrum rücken: Googlebooks. Entsprechende Notebooks sind zum Start von Acer, Asus, Dell, HP und Lenovo geplant. Google selbst steigt bei den Googlebooks nicht wieder mit eigenen Geräten ein.

Googlebooks nutzen den Android Tech Stack

Google verfolgt das Ziel, ChromeOS und Android technisch zu einer gemeinsamen Plattform zusammenzuführen. Dabei werden immer mehr Android-Komponenten in ChromeOS integriert – etwa App-Frameworks, KI-Funktionen, Fensterverwaltung und Systemdienste –, sodass Smartphones, Tablets und Laptops langfristig auf derselben Basis laufen können. Die neuen Googlebooks vollziehen in diesem Punkt eine weitere Annäherung und nutzen den „Android Tech Stack“, wie Google auf Nachfrage bestätigte.

Googlebooks are a new category of laptops built on the Android tech stack, bringing the best Google software, premium hardware and Gemini together.

Google

Acer, Asus, Dell, HP und Lenovo bringen Googlebooks

Chromebooks gibt es seit mittlerweile über 15 Jahren, und von Anfang an mussten Notebook-Hersteller gewisse Zertifizierungshürden von Google meistern, um Notebooks mit ChromeOS dann auch als Chromebook vermarkten zu dürfen. Seit dem Herbst letzten Jahres gibt es mit den Chromebook Plus eine zusätzliche Kategorie für Premium-Chromebooks mit höheren Anforderungen. Was jetzt bei den Googlebooks ein Googlebook sein darf, schreibt Google ebenfalls vor.

Acer, Asus, Dell, HP und Lenovo erfüllen diese Anforderungen und sind für die neue Kategorie die Launch-Partner, die „premium craftsmanship and materials“ versprechen. Noch sind die einzelnen Notebook-Modelle nicht im Detail vorgestellt worden, sie sollen Google zufolge aber „in allen Formen und Größen“ auf den Markt kommen.

Googlebooks bekommen wieder eine Glowbar

Erkennen können soll man Googlebooks stets ein einem verpflichtenden Merkmal: der Glowbar, die jedes Googlebook haben muss, um diesen Namen tragen zu dürfen. Die Glowbar hatte anno 2013 schon das Chromebook Pixel, spätere Pixelbooks dann aber nicht mehr. Ein Revival eigener Pixel-Googlebooks ist vorerst aber nicht geplant, wie Google auf Nachfrage erklärte. Das letzte Notebook von Google bleibt damit das Pixelbook Go.

We are working with partners like Acer, Asus, Dell, HP, Lenovo. We don’t have anything to share at the moment on 1st party hardware.

Google

Gemini Intelligence im Zentrum der Plattform

Googlebooks nutzen neben der Glowbar zudem immer den Android-Tech-Stack. Im Zentrum der neuen Plattform steht dabei stets Gemini Intelligence, ein neuer Oberbegriff von Google für Smartphones und Notebooks, der die tiefe Integration des KI-Assistenten und verschiedener Dienste in das Betriebssystem signalisiert.

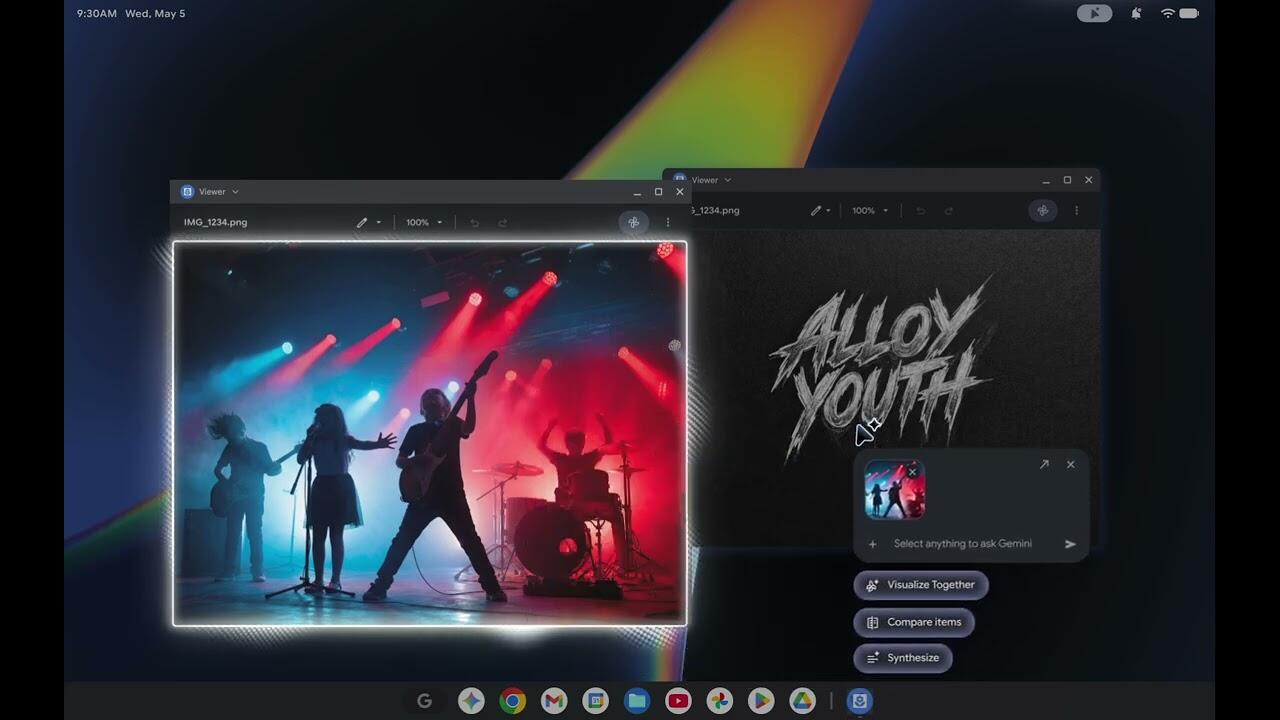

Der Cursor wird zum Magic Pointer

Auf einem Googlebook zeigt sich Gemini Intelligence bereits anhand des Cursors. Auf einem Googlebook heißt der Cursor „Magic Pointer“, da er mit kurzem Wackeln kontextbezogene KI-Funktionen zur Verfügung stellen kann. Das Wackeln über einem Datum einer E-Mail ermöglicht das Erstellen eines Termins. Bei zwei geöffneten Bildern kann der Magic Pointer diese mittels KI zu einer neuen Aufnahme verschmelzen.

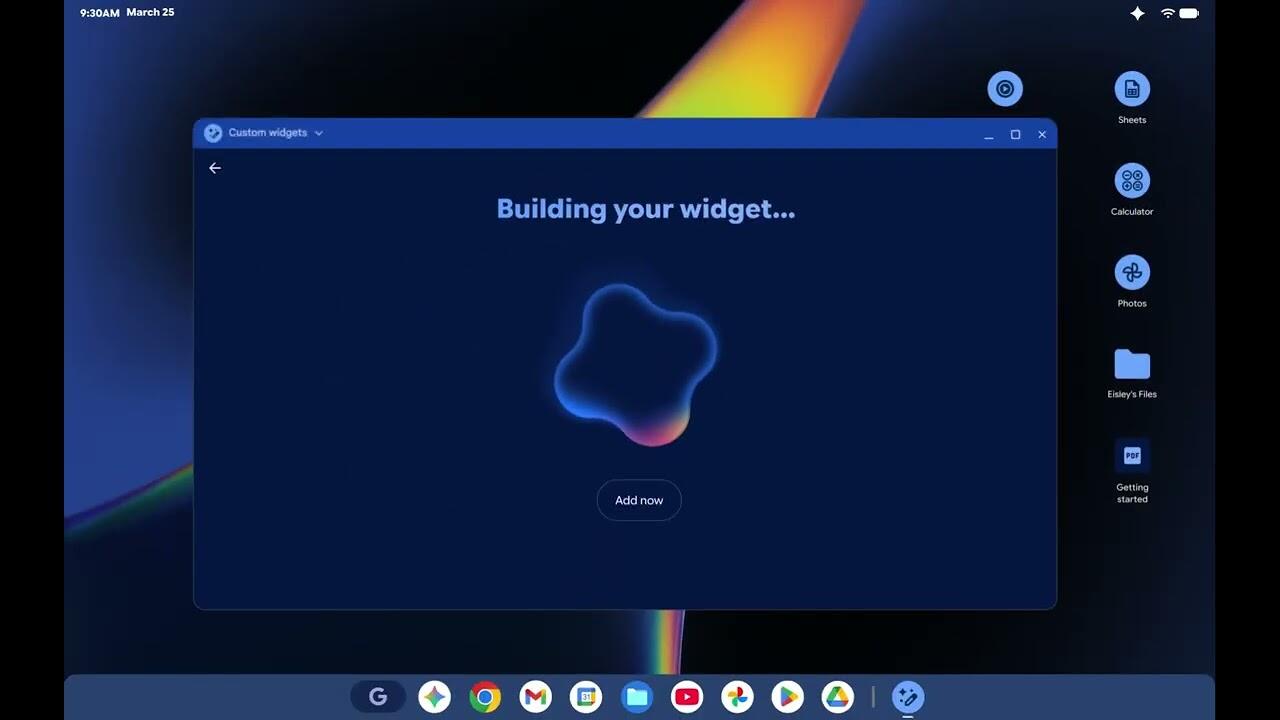

Widgets mit Gemini-Prompt erstellen

Analog zur Einführung der Funktion für Android bieten auch Googlebooks fortan „Create your Widget“, um aus einem Gemini-Prompt ein eigenes Desktop-Widget erstellen zu können. Gemini soll für den Anwender auch das Internet sowie Apps wie Gmail und den Kalender durchsuchen können, um ein personalisiertes Dashboard zu erstellen. Gemini kann sich für den Nutzer auch um Flüge, Hotels, Restaurants und mehr kümmern.

Googlebooks haben Smartphone-Zugriff

Das Betriebssystem kann zudem Android-Apps ausführen, es erlaubt auch die Nutzung von Smartphone-Apps auf dem Notebook. Die direkte Verknüpfung von Googlebook und Android-Smartphone erlaubt die Bedienung über den Laptop. Mittels „Quick Access“ soll sich auch auf alle Dateien des Smartphones zugreifen lassen. Fraglich ist in diesem Punkt, ob Google ähnliche Hürden in der EU wie Apple bevorstehen, weshalb Apple die iPhone-Bedienung über den Mac derzeit nicht in Europa anbietet.

ComputerBase hat Informationen zu diesem Artikel von Google unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Apps & Mobile Entwicklung

Google im Auto: Android Auto erhält immersive Navigation und Video-Support

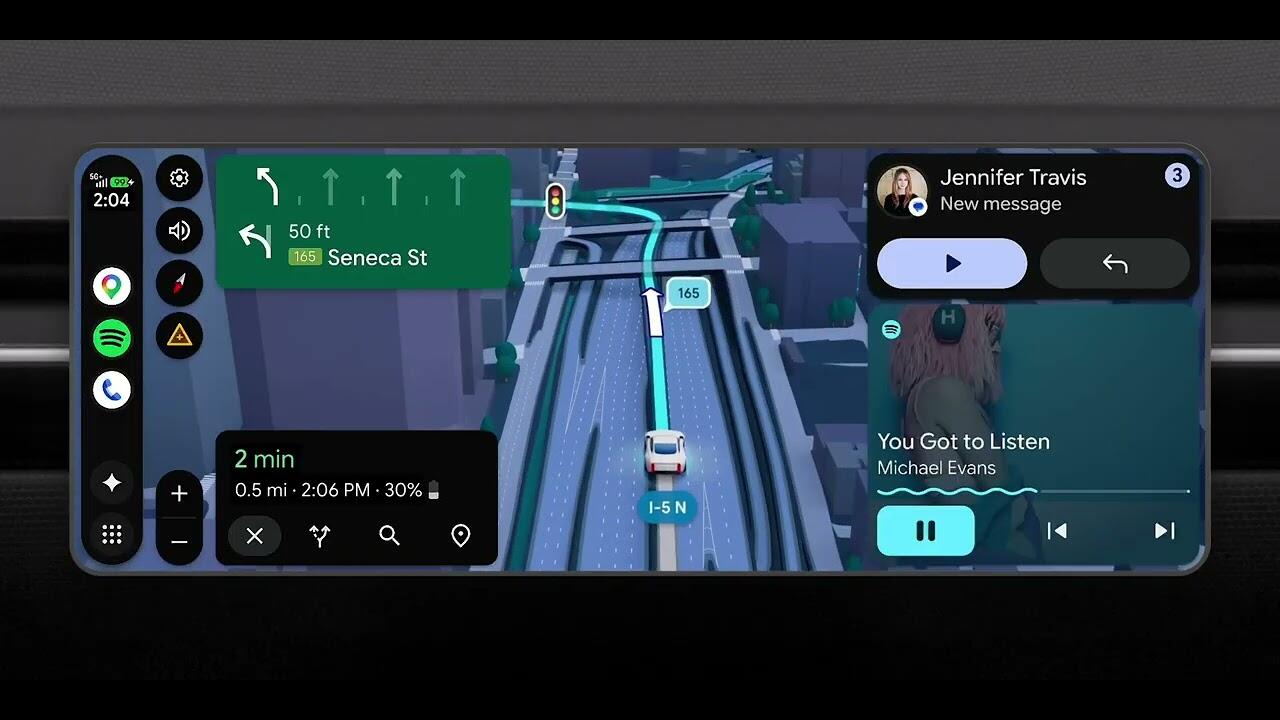

Google nimmt sich zur Android Show im Vorfeld der I/O auch Android Auto und dem vollintegrierten „Google built-in“ an. Die letztes Jahr eingeführte Designsprache Material 3 Expressive hält jetzt auch bei Android Auto Einzug. Neu sind außerdem die immersive Navigation, Gemini Intelligence und Full-HD-Video-Unterstützung.

Material 3 Expressive für Android Auto

Nach der Einführung von Material 3 Expressive auf Smartphones und Smartwatches im letzten Jahr hält Googles aktuelle Designsprache auch Einzug auf Android Auto. Sie setzt auf kräftige Farben, flexible Formen, größere Typografie und fließende Animationen, um die Benutzeroberfläche persönlicher, lebendiger und intuitiver wirken zu lassen.

Android Auto unterstützt mehr Displayformate

Android Auto lässt sich mit dem Update zudem besser auf unterschiedlich geformten Bildschirmen nutzen. Neben rechteckigen Displays unterstützt die Projektion vom Smartphone fortan flexible Formate wie das runde Display im aktuellen Mini, den trapezförmigen Bildschirm des BMW iX3 oder die langgezogene Ultrabreitbild-Anzeige von Lucid, wie Google beispielhaft mit der Bebilderung hervorhebt. Anpassen lässt sich die Android-Auto-Benutzeroberfläche jetzt auch mit Widgets, wie sie seit iOS 26 auch von Apple in CarPlay geboten werden.

Immersive Navigation in Google Maps

Zur neuen Benutzeroberfläche explizit von Google Maps gehört die immersive Navigation, eine Routenführung mit 3D-Darstellung für Fahrstreifen, Gebäude, Überführungen und Gelände. Dabei werden kritische Informationen wie Spuren, Ampeln und Stoppschilder hervorgehoben, um die Navigation zu vereinfachen. Google erklärt die neue Navigation zum größten Update in Google Maps seit über einer Dekade.

Full-HD-Video mit 60 FPS und neue Musik-Apps

Steht das Auto hingegen, lassen sich via Android Auto jetzt auch Full-HD-Videos mit bis zu 60 FPS wiedergeben – zum Start unter anderem mit YouTube. Das Feature soll laut Google „später im Jahr“ zuerst bei BMW, Ford, Genesis, Hyundai, Kia, Mahindra, Mercedes-Benz, Renault, Škoda, Tata und Volvo angeboten werden. Sobald gefahren wird, wechselt Android Auto von der Video- zu einer reinen Audio-Wiedergabe.

Apropos Audio: Dolby Atmos via Android Auto kommt zuerst bei BMW, Genesis, Mahindra, Mercedes-Benz, Renault, Škoda, Tata und Volvo. YouTube Music und Spotify erhalten Updates der Benutzeroberfläche, um die Bedienung im Auto zu vereinfachen.

Gemini Intelligence kommt ins Auto

Darüber hinaus führt Google unter dem neuen Oberbegriff „Gemini Intelligence“ eine Reihe von KI-gestützten Gemini-Funktionen jetzt auch für Android Auto ein. Google hatte die Integration von Gemini in Android Auto bereits zur letztjährigen I/O in Aussicht gestellt. Erst jetzt sei Gemini aber „widely available in Android Auto“, wie Google erklärt. „Gemini Intelligence“ soll „später im Jahr“ Einzug halten, sofern auch das verbundene Android-Smartphone bereits „Gemini Intelligence“ unterstützt.

Bei Nachrichten kann Gemini mittels „Magic Cue“ den Kontext der Frage verstehen und eine Antwort auf Basis der Informationen der Textnachrichten, E-Mails oder Kalender des Nutzers formulieren. Das Problem? Magic Cue gibt es selbst auf dem Smartphone nach wie vor nicht in Deutschland. Gemini wird den Nutzer während der Fahrt künftig auch mit DoorDash-Bestellungen unterstützten können. In Deutschland ist DoorDash über die Anbieter Flink und Wolt präsent.

Upgrades für Fahrzeuge mit „Google built-in“

Upgrades erfährt neben Android Auto auch das native „Google built-in“, das native Android-Betriebssystem für Infotainmentsysteme (und mehr). Auch für diese Plattform sind die neuen Musik-Apps von YouTube und Spotify sowie der nahtlose Übergang von der Video- zur Audio-Wiedergabe geplant. Darüber hinaus sind erstmals Meeting-Apps wie Zoom vorgesehen.

In der nativen Umsetzung kann Gemini zusätzlich Fragen rund um das Auto beantworten, etwa zu Schaltern und Kontrollleuchten im Cockpit sowie zu physischen Eigenschaften des Fahrzeugs. Gemini könne dem Nutzer zum Beispiel beantworten, ob der neu erworbene Fernseher auch tatsächlich in den Kofferraum passt.

Die immersive Navigation erhält bei „Google built-in“ zudem eine Echtzeit-Spurführung per Zugriff auf die Frontkamera des Fahrzeugs. Das System kann darüber erkennen, auf welcher Spur sich das Auto tatsächlich befindet und die Routenführung entsprechend anpassen. Die Neuerungen sollen schrittweise über das Jahr eingeführt werden.

ComputerBase hat Informationen zu diesem Artikel von Google unter NDA erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

-

Künstliche Intelligenzvor 3 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Der beste Luftgütesensor im Test – CO₂, Schadstoffe & Schimmel im Blick

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview

-

Apps & Mobile Entwicklungvor 2 Monaten

Apps & Mobile Entwicklungvor 2 MonatenMähroboter ohne Begrenzungsdraht für Gärten mit bis zu 300 m²

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonateniPhone Fold Leak: Apple spart sich wohl iPad‑Multitasking