Apps & Mobile Entwicklung

Neuer Film ist in Arbeit!

Das große Finale von Stranger Things Ende 2025 ließ viele von Euch mit brennenden Fragen zurück. In einem kommenden Film liefert Netflix endlich das entscheidende Puzzleteil, um Henry Creels düsteres Schicksal vollständig zu entschlüsseln. Doch der angekündigte Film hat einen ganz besonderen Kniff.

Nachdem das Netflix-Flaggschiff in der Silvesternacht 2026 unter Tränen und gewaltigen Lore-Eruptionen sein Ende fand, blieb bei vielen Zuschauer:innen ein fader Beigeschmack zurück. Das große Finale galt als globales Kultur-Event. Dennoch kritisierten Hardcore-Nerds und Gelegenheitsseher gleichermaßen, dass die tiefen Beweggründe von Henry Creel alias Vecna teilweise schemenhaft blieben. Das Gefühl, eine essenzielle Episode verpasst zu haben, war kein Zufall, sondern strategisches Kalkül der Duffer-Brüder. Wichtige Antworten über die Natur des Upside Down und den Ursprung des Bösen verlegten sie schlichtweg in ein anderes Medium, das Theater.

Doch nach dem massiven Echo der Community hat Netflix nun offensichtlich reagiert. Die Wissenslücken werden genau dort geschlossen, wo sie für alle zugänglich sind – direkt auf Euren heimischen Bildschirmen. Damit liefert der Streamer die längst überfällige Antwort auf die drängendsten Fragen der Fans. Seht hier den Trailer mit Bildern des Broadway-Stückes:

Ich bin damit einverstanden, dass externer Inhalt geladen wird. Personenbezogene Daten werden womöglich an Drittplattformen übermittelt. Nähere Informationen enthält die Datenschutzerklärung.

Henry Creel wird Vecna: Endlich sehen wir alle, was geschah!

Der Streaming-Riese hat grünes Licht für eine professionelle Verfilmung des preisgekrönten Theaterstücks „Stranger Things: The First Shadow“ gegeben. Das berichtet zumindest Collider, die offizielle Bestätigung fehlt noch. Erwartet jedoch kein klassisches Live-Action-Reboot! Statt einer neuen Verfilmung handelt es sich um eine technisch brillante Aufzeichnung der Broadway-Show. Doch keine Sorge, Euch droht kein billiger Abklatsch. Mit den Tony-Awards für das beste Szenenbild, Licht und Sound-Design im Rücken verspricht die Produktion ein Spektakel, das weit über herkömmliche Bühnenmitschnitte hinausgeht.

Das Skript stammt von Serien-Veteranin Kate Trefry. Gemeinsam mit den Duffers und dem „Adolescence“-Schöpfer Jack Thorne taucht sie tief in die 1950er Jahre von Hawkins ab. Im Zentrum steht der junge Henry Creel, dessen Schicksal untrennbar mit dem Militärdienst seines Vaters Victor auf der USS Eldridge verknüpft ist. Dabei handelt es sich um das legendäre Schiff des paranormalen Philadelphia-Experiments. In der Hauptrolle brilliert Louis McCartney neben T.R. Knight und Alex Breaux (der in anderer Rolle sogar in der Serie zu sehen ist).

Besonders wichtig für das emotionale Verständnis ist Gabrielle Nevaeh als Patty Newby, Henrys erste große Liebe, die uns zeigt, dass der spätere Antagonist keineswegs böse geboren wurde. Die Kameras halten bereits im Februar 2026 drauf, um die Originalbesetzung vor dem Cast-Wechsel am 29. März einzufangen. Damit ist ein Release noch in diesem Jahr absolut realistisch.

Eine überfällige, (zu?) späte Entscheidung

Die Entscheidung, dieses Projekt auf die Plattform zu bringen, markiert einen dringend notwendigen Strategiewechsel im Stranger-Things-Kosmos. Lange Zeit blieb das Wissen über Henrys erste, schicksalhafte Begegnung mit dem Gedankenschinder hinter dreistelligen Ticketpreisen in London und New York verborgen. Wir Netflix-Binge-Watcher schauten dabei in die Röhre.

Erst durch diese Aufzeichnung erfahren wir im Detail, wie die unheilvolle Symbiose zwischen Henry und der Schattenwelt wirklich begann. Ein Aspekt, der im Finale von Staffel 5 für erhebliche Verwirrung in der Community sorgte.

Es ist der finale Baustein, der Euch gefehlt hat. So könnt Ihr das Monster Vecna als tragische Figur begreifen lernen und seine Verbindung zum Upside Down besser verstehen. In das Gesamtgefüge des Franchise fügt sich der Film dabei durchaus nahtlos ein: Zwischen der 2025er Dokumentation „Hinter den Kulissen“ und dem im April 2026 startenden Spin-off „Stranger Things: Tales from ’85“ hält Netflix das Universum gehaltvoll am Leben. Ihr bekommt nun endlich die Chance, Hawkins’ dunkelstes Geheimnis zu lüften. Und das, ohne teure Flugtickets oder hochpreisige Theaterkarten zu bezahlen. Schöner wäre es dennoch gewesen, wenn wir diese Geschichte früher bekommen hätten – vor dem Serienfinale!

Habt Ihr schon Eure Theorien zur USS Eldridge parat? Oder wartet Ihr erst auf den Release, um die Puzzleteile von Vecnas Schicksal endlich zusammenzusetzen? Teilt Euer Wissen und diskutiert mit uns über die Geheimnisse der Schattenwelt!

Apps & Mobile Entwicklung

Angebliche Packaging-Probleme: Nvidia Rubin Ultra reizt CoWoS-L von TSMC aus

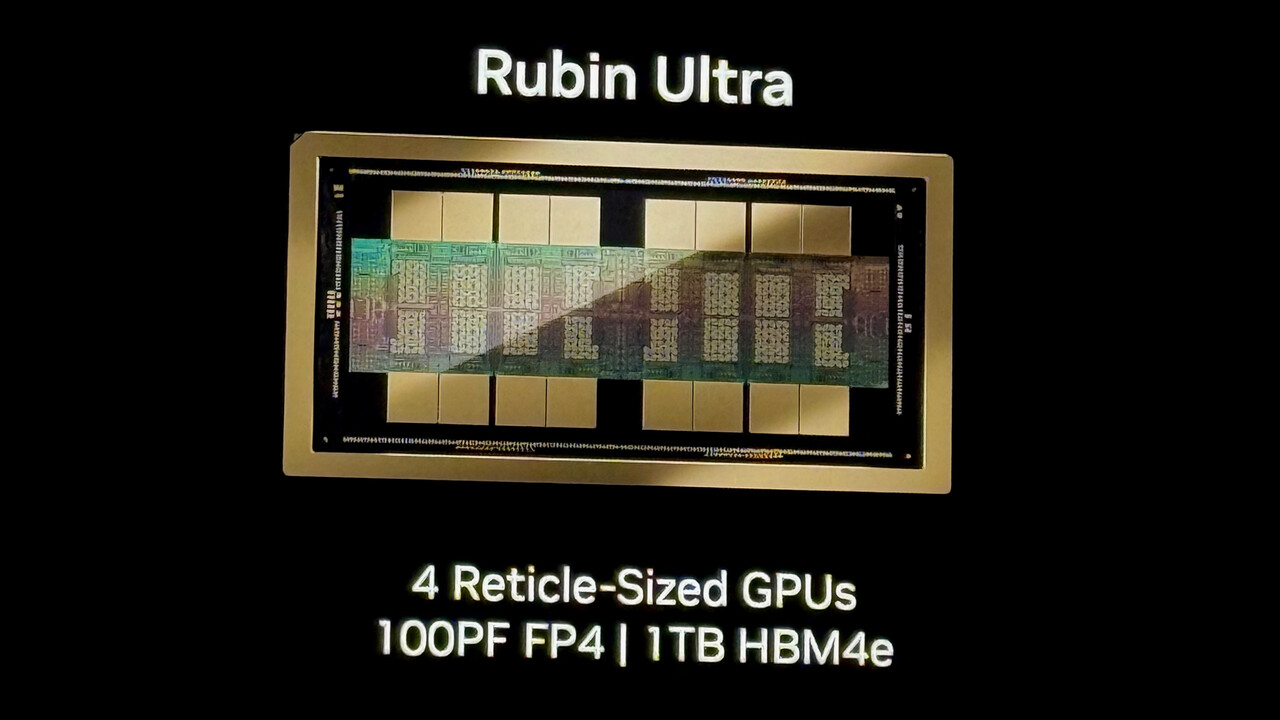

Seit Wochenbeginn wird spekuliert, ob Nvidias Rubin Ultra wirklich wie geplant Ende 2027 kommen wird. Laut aktuellen Gerüchten, die sich auf Analysten berufen, scheint es Probleme beim Packaging bei TSMC zu geben. Demnach ist das Produkt wohl zu groß und zu komplex und überreizt so das CoWoS-Design.

Nvidia bringt TSMCs CoWoS ans Limit

Seit 2021 bereits in Produktion, hat sich CoWoS (Chips on Wafer on Substrate) zum Kassenschlager entwickelt. Kein moderner größerer Chip ist ohne diese Technologie verfügbar. Von CoWoS-S verlagerte sich der Prozess zuletzt zu CoWoS-L, das noch größere Chips erlauben wird. Bei CoWoS-S war bei der 3,3-fachen Größe der theoretischen Einzelchips auf einem Interposer das Limit erreicht, bei CoWoS-L wird dies unter anderem durch den viel größeren Interposer von 120 × 150 mm aber auch zusätzliche integrierte Features wie Spannungsregler (FIVR, Fully Integrated Voltage Regulator) nun schon einmal auf bis zu 9,5-fache Reticle-Größe gestreckt.

Als Reticle-Size-Limit in der Branche gilt die Maximalgröße eines einzelnen Chips, der mit gängigen Belichtungsmaschinen Kantenlängen von bis zu 26 × 33 mm bzw. 858 mm² haben kann. Im Jahr 2027 können so zusammengepackte Riesenchips erscheinen, die mindestens vier Chips flankiert von I/O und 12 HBM4E-Stacks beherbergen.

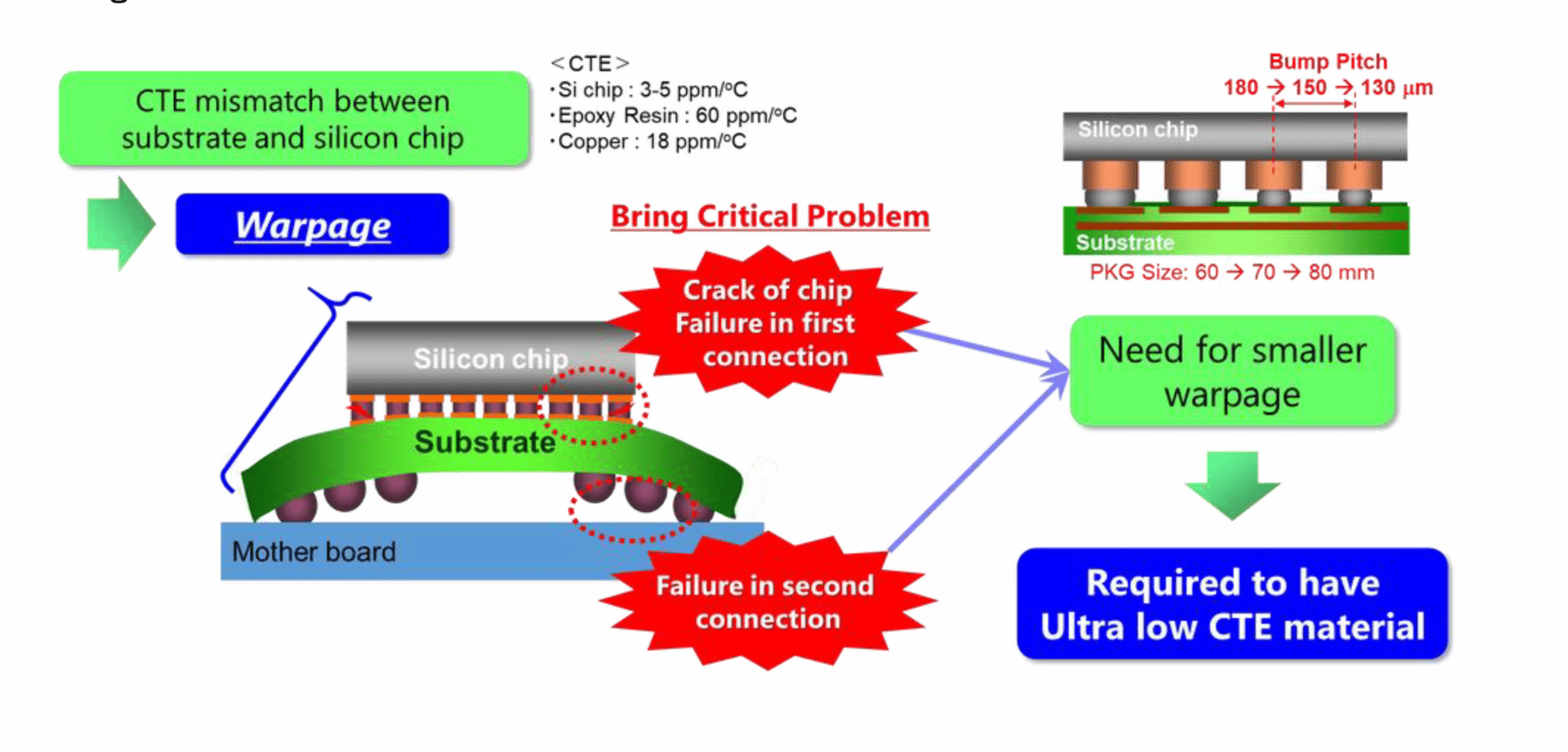

„Warpage“ bei Rubin Ultra

Die Rubin-Ausbaustufe Rubin Ultra setzt laut bisherigen Gerüchten genau auf so ein Design, während der Nachfolger Feynman erstmals Die-Stacking nutzen wird. Rubin Ultra mit seinen insgesamt 4 Dies nebst HBM4e wird zuvor das reguläre Packaging dabei wohl nahezu voll ausreizen, weshalb nun angeblich Probleme zum Vorschein kamen. So sei in ersten Testläufen vermehrt das sogenannte „Warpage“ aufgetreten, also Verformungen des am Ende zusammengesetzten Chip, der so mitunter nicht mehr wie gewollt oder gar nicht funktioniert.

Das Problem ist vor allem bei größeren Multi-Chip-Packages nicht neu, nun jedoch zurück. Der Ausweg scheint, dass Rubin Ultra auch auf einen 2-Die-Design basiert, das dann nur für die Maximalkonfiguration mit einem zweiten Chip kombiniert wird.

Die andere Alternative sind neue Packaging-Methoden. Glas-Substrat ist viel weniger anfällig für Warpage – allerdings noch Jahre von einem großen Serieneinsatz entfernt. Aber auch der Einsatz von CoPoS, Chips on Panel on Substrate, könnte dem Sichverziehen teilweise entgegenwirken. Hier kamen zuletzt sehr viele Gerüchte über diese Packaging-Methode auf, und auch, dass TSMC sie wohl schnell umsetzen will.

Da diese Neuheiten aber wohl alle kaum rechtzeitig fertig werden, um mit Nvidias Roadmap einherzugehen, wird es wohl auf einen angepassten Chip für Rubin Ultra hinauslaufen. Wie genau dieser jedoch aussieht, bleibt ein Gerücht.

Apps & Mobile Entwicklung

HP Dimension mit Google Beam im Hands-on

Im Rahmen von HPs Hausmesse Imagine hatte ComputerBase in New York die Gelegenheit, ein Demo-Setup von HP Dimension mit Google Beam auszuprobieren. Dabei konnte das Produkt zur 3D-Videotelefonie in Lebensgröße mächtig Eindruck schinden: Das klappt beeindruckend gut! Die Hürden sind zum Marktstart im Herbst aber gewaltig.

Erster Eindruck: Da sitzt eine Person hinter Glas

Die Tür geht auf, ich betrete einen kleinen Raum. Auf einem halbrunden Schreibtisch steht eine Art Fernseher, davor ein Bürostuhl. Ich setze mich darauf. Und plötzlich sitzt mir eine Person in 3D gegenüber – das ist gar kein Fernseher, sondern nur eine Glasscheibe?!

Erst als ich genauer hinschaue, fällt ein feines Raster auf. Die dreidimensionale Darstellung wirkt nicht perfekt scharf, aber ist durchweg ausreichend, um die Mimik der gegenübersitzenden Person und sogar einzelne Poren auf der Haut klar erkennen zu können. Bewege ich den Kopf nach links oder rechts, verändern sich Perspektive und Raumklang. Das Gefühl bleibt: Da sitzt jemand hinter dem Glas. Ich sehe meinen Gesprächspartner nicht auf einem Bildschirm, sondern einen Meter vor mir, physisch im Raum – nur eben unerreichbar. Denn die Person sitzt nicht hier mit mir in New York, sondern tatsächlich in Austin, Texas.

Dieser erste Eindruck, der sich zum Start meiner kurzen Demo-Session mit HP Dimension einstellt, trägt erstaunlich weit. Auch einfache Gesten wirken glaubwürdig. Als mein Gegenüber einen Apfel anhebt und mir entgegenstreckt, nur wenige Dutzend Zentimeter vor mein Gesicht, entsteht das Gefühl, ich könne danach greifen – aber der Griff führt haptisch ins Leere, wenngleich meine Hand optisch im Apfel verschwindet. Gleichzeitig zeigen sich Grenzen: feine Artefakte, leichtes Flimmern, und eine gewisse Künstlichkeit bei genauerem Hinsehen. Es ist kein perfektes Abbild der Realität, aber nah genug, dass das Gehirn den Unterschied für den Moment ausblendet. Und genau darin liegt die Wirkung des Systems.

Von der Kamera zum gerenderten Gegenüber

Technisch handelt es sich gar nicht um ein klassisches Video, erfahre ich im Anschluss, sondern um eine mehrstufige Rekonstruktion. Sieben Kameras und ein Beamforming-Array bestehend aus zwölf Mikrofonen, allesamt verteilt im Rahmen des 65-Zoll-Panels mit 8K-Auflösung, sowie zwei weitere Mikrofone auf dem Tisch erfassen die Person aus unterschiedlichen Winkeln. Die Daten werden in einem Google-Rechenzentrum in Echtzeit verarbeitet und als synthetisches Bild neu gerendert.

Ich sitze also gar keinem Videostream im klassischen Sinne gegenüber, sondern einem generierten – aber hyperrealistischen – 3D-Abbild, das kontinuierlich an Perspektive und Blickrichtung angepasst wird. Wie Google erklärt, kommt dabei ein speziell trainiertes KI-Modell für volumetrische Videoinhalte zum Einsatz. „Normale“ Foto- oder Videoaufnahmen des Produkts können dem nicht gerecht werden, argumentiert HP, weswegen eigene Aufnahmen der Redaktion in diesem Artikel fehlen. Das ist schade, aus meiner Perspektive aber durchaus nachvollziehbar.

Wie das Display Tiefe erzeugt

Denn die Darstellung erfolgt über ein sogenanntes Lichtfeld-Display respektive mittels Linsenrasterbild. Dabei werden nicht einfach zwei Bilder für linkes und rechtes Auge erzeugt, sondern eine Vielzahl leicht unterschiedlicher Perspektiven gleichzeitig dargestellt. Möglich wird das durch feine Linsen oder Prismen auf dem Panel, die Lichtstrahlen gezielt in verschiedene Richtungen lenkt. Je nach Position der Augen trifft dadurch jeweils ein anderes Teilbild auf die Netzhaut. Bewegt man den Kopf, verschiebt sich dieser Winkel kontinuierlich, analog eines Parallax-Effektes, wodurch neue Perspektiven sichtbar werden. Bekannt ist diese Funktionsweise beispielsweise von Wackelbildern, wie sie etwa auf Grußkarten zu finden sind – bei HP Dimension ist die Qualität aber deutlich höher.

Die effektive Auflösung des 8K-Panels verteilt sich allerdings dennoch auf diese verschiedenen Blickwinkel. Das erklärt, warum Details zwar gut erkennbar sind, aber nicht ganz das Auflösungsvermögen eines klassischen 2D-Displays mit 7.860 × 4.320 Pixeln erreicht wird. Gleichzeitig entstehen potenziell Artefakte wie ein leichtes Flimmern oder Moiré-Effekte, da das Bild aus diskreten View-Zonen besteht. Das System versucht, diese Übergänge durch Tracking von Kopf- und Blickbewegungen möglichst unauffällig zu halten.

Blickkontakt, Licht und Rendering-Tricks

Einen wichtigen Beitrag für das Gefühl eines gewöhnlichen Gesprächs ist außerdem die Anpassung des Blickkontakts: Das bei Videotelofonie übliche Problem, dass die Pupillen des Gesprächspartners nicht auf die eigenen Augen, sondern die Kamera am Rande des Displays gerichtet sind, wird beim Rendern des 3D-Abbilds umgangen. Es entsteht konsequent der Eindruck, mein Gesprächspartner schaue mir in die Augen, wenn er mich denn ansieht; ein natürliches Gefühl von Blickkontakt entsteht. Gleichzeitig werden Beleuchtung und Lichttemperatur angepasst, um Unterschiede zwischen Aufnahme- und Wiedergabeseite auszugleichen.

Im Kern ist das System damit weniger eine Bildübertragung von Kamera zu Display, sondern integriert eine durchgängige Rendering-Pipeline. Aufnahme, Rekonstruktion und Darstellung sind eng miteinander verzahnt und aufeinander abgestimmt, tatsächlich aufgenommene Pixel sieht am Ende aber keiner der beiden Anwender. Ist mir das in irgendeiner Art und Weise aufgefallen? Nein, tatsächlich gar nicht.

Nichtsdestoweniger berichtete ein anderer Journalist, der an der Demo-Session teilnahm, nach seinem Beam-Telefonat von leichten Kopfschmerzen und müden Augen, was er aber von allerhand 3D-Displays gewohnt sei. In unserer Runde war das ein Einzelfall und auch ich kann mich nicht über derartige Nebenwirkungen beschweren. Es ist aber offen, inwiefern auch andere Menschen bei der Verwendung von HP Dimension mit vergleichbaren Problemen zu kämpfen haben – und inwiefern die Hersteller diese mildern oder gar abstellen können.

Spatial Audio und Live-Übersetzung

Für ein authentisches Gesprächserlebnis ist aber offenkundig auch der Ton relevant. Die zahlreichen Mikrofone erfassen die Stimme und ermöglichen eine räumliche Wiedergabe. Dabei übernehmen die beiden Mikrofone auf dem Tisch die eigentliche Sprachaufnahme, wohingegen die zusätzlichen Mikrofone im Rahmen zur Positionsbestimmung mittels Triangulation dienen. Über vier Lautsprecher lässt sich die Stimme anschließend so im Raum platzieren, dass sie akustisch mit der dargestellten Person übereinstimmt.

HP und Google sehen außerdem vor, dass das fertige Produkt in Echtzeit zwischen verschiedenen Sprachen der Gesprächspartner übersetzen können soll. Dabei soll das System dynamisch auch Tonfall, Tonhöhe und Charakteristiken der Stimme berücksichtigen und die Audioausgabe entsprechend anpassen. Basis der Übersetzung sei – wenig verwunderlich – ein KI-Modell. Diese Funktion konnte ComputerBase aber im Rahmen von Präsentation und Demo weder beobachten noch selbst ausprobieren.

Kooperation zwischen Google und HP

Die zugrunde liegende Technologie stammt ursprünglich von Google und basiert auf Project Starline. Dort wird die 3D-Rekonstruktion, das Rendering sowie die gesamte Plattform entwickelt und betrieben. Auch die Cloud-Infrastruktur und die Streaming-Pipeline sind Teil dieses Systems, das unter dem Namen Google Beam vermarktet wird.

HP übernimmt mit Dimension dagegen die Rolle des Hardware- und Systemintegrators. Das Unternehmen baut das Display, integriert die Kameras, Mikrofone und Recheneinheit und sorgt dafür, dass das System als geschlossenes Produkt zuverlässig funktioniert und vermarktet werden kann. Dazu gehören auch Aspekte wie Kalibrierung, thermisches Design und die Integration in Meetingräume.

Voraussetzungen und Anwendungsbereich

Das gesamte System ist stark auf kontrollierte Bedingungen angewiesen. Sitzposition, Abstand zum Display und Beleuchtung sind vorgegeben und lassen nur wenig Spielraum. Der halbrunde Tisch vor dem Display beispielsweise ist exakt so dimensioniert, dass die Gesprächspartner den richtigen Abstand zu Kameras, Mikrofon-Array und Panel wahren. Und Lichtquellen sollten idealerweise nur hinter dem Display platziert sein, weswegen HP Dimension über ein starkes Hintergrundlicht verfügt und die sonstige Beleuchtung im Demo-Raum ausgeschaltet war. Ein Einsatz im direkten Sonnenlicht etwa ist nicht möglich.

Schnelles Internet und viel Energie nötig

Hinzu kommt die Abhängigkeit von passender Infrastruktur. Für den Betrieb werden stabile Internetverbindungen benötigt. HP empfiehlt eine Bandbreite im Bereich von mindestens 50 Mbit/s symmetrisch sowie eine Paketumlaufzeit von unter 40 ms. Das setzt nicht nur Vorgaben für die Anbindung der beiden HP-Dimension-Module ans Internet, sondern auch die Verfügbarkeit passender Rechenzentren voraus – bei einer derart latenzsensiblen Anwendung ist es äußerst ungünstig, wenn passende Rechenkapazität gerade nur auf der anderen Seite des Planeten verfügbar ist. Anfällig für Internetprobleme ist das System aber auch im Idealfall noch: Während meiner Hands-on-Session waren zeitweise Bild und Ton nicht synchron, was in dieser Form bei anderen Probanden jedoch nicht vorkam.

Erwähnenswert ist für die vorgestellte Implementierung auch der Energiebedarf: 600 Watt verbraucht ein HP-Dimension-Modul während eines laufenden Videoanrufs. Die Rechenleistung in der Cloud ist dabei selbstverständlich noch außen vor, doch zu diesem Thema bleibt Google bislang generell vage – Details zur Hard- und Software gibt es nicht. Die lokale Recheneinheit des Beam-Setups beschreibt HP hingegen salopp als „modifizierte Chromebox“.

Einsatz heute: Klar abgegrenzt

Aktuell ist das System auf Gespräche zwischen zwei Personen ausgelegt. Erweiterungen auf mehrere Teilnehmer oder komplexere Szenarien sind zwar vorgesehen, stellen aber aktuell noch erhebliche technische Herausforderungen dar, schildert HP auf Nachfrage. Einerseits geht es darum, mehr als nur zwei HP-Dimension-Module miteinander zu verbinden, wo sich der Hersteller für die nahe Zukunft zuversichtlich zeigt. Aber insbesondere die korrekte Darstellung aus verschiedenen Blickwinkeln für mehrere Betrachter vor einem Modul sei komplex und könnte zusätzliche Hardware oder neue Displayansätze erfordern. Außerdem gelte es noch zu erproben, inwiefern das Gefühl eines authentischen Gesprächs aufrecht erhalten werden könne, wenn die gegenübersitzende Person nicht in Lebensgröße dargestellt werden kann, falls kleinere Displays zum Einsatz kommen.

Entsprechend bleibt der Einsatzbereich vorerst eng gefasst, denn auch die finanziellen Hürden sind hoch. Die erste kommerzielle Umsetzung, HP Dimension mit Google Beam – also genau das Modul, das in einer Entwicklungsversion von mir ausprobiert wurde –, liegt früheren Angaben zufolge bei rund 25.000 US-Dollar pro Gerät. HP gab aber zu verstehen, dass das fertige Produkt zum Start im Herbst 2026 realistisch eher noch teurer werde. Ziel sei es aber, beschwichtigt HP auf Nachfrage, den Preis mit zukünftigen Generationen zu senken.

Laufende Kosten für die Google-Server

Hinzu kommen aber in jedem Fall noch laufende Lizenzkosten für die Plattform von Google. Pro Modul sollen 5.500 US-Dollar im Jahr anfallen, was letztlich die nötige Rechenleistung in der Cloud bezahlen soll. Und für eine Verbindung werden offenkundig zwei dieser Systeme benötigt, was die effektiven Kosten für das erste Jahr HP Dimension auf über 60.000 US-Dollar hebt. In der Konsequenz richtet sich die Lösung vorerst an Unternehmen. Erste Kunden nennen HP und Google bereits: Deloitte, Salesforce, Citadel, NEC, Hackensack Meridian Health, Duolingo und Recruit.

Und was versprechen sich diese Pionierkunden von HP Dimension? Die Hersteller unterfüttern die beworbenen Vorteile der Plattform mit eigens durchgeführten Studien, die konkret auf einen Einsatz im betrieblichen Umfeld eingehen. Demnach steige der erfolgreiche Einsatz nonverbaler Kommunikation, also etwa von Mimik, Gesten oder Augenkontakt, gegenüber herkömmlichen Videotelefonielösungen um 39 Prozent. Außerdem falle die Konzentration der Teilnehmer auf das Gespräch während eines Meetings per Google Beam um 14 Prozent höher aus und im Anschluss könnten sich beide an 28 Prozent mehr der im Meeting genannten Informationen erinnern.

Langfristiges Ziel: Mehr Nähe trotz Distanz

Unterm Strich überwiegt dennoch der positive erste Eindruck. Die Technologie funktioniert nicht nur, sie hebt sich qualitativ deutlich und in beeindruckender Weise von klassischer Videotelefonie ab. Der Unterschied ist nicht subtil, sondern unmittelbar spürbar. Gespräche wirken natürlicher, direkter und weniger vermittelt. Es entsteht tatsächlich der Eindruck, sich einen Raum zu teilen und gemeinsam an einem Tisch zu sitzen, statt auf einen Bildschirm zu schauen – die eigene Wahrnehmung wird effektiv ausgetrickst.

Gerade darin liegt das eigentliche Potenzial. Die Technik reduziert Distanz nicht nur funktional, sondern vermittelt erfolgreich ein Gefühl von Nähe und erlaubt nonverbale Kommunikation auf einer Ebene, die bisher nur im realen Kontakt vor Ort möglich war. Gespräche mit weit entfernten Personen – ob im beruflichen Kontext oder privat – werden nicht bloß in der Qualität gesteigert, sprich hinsichtlich Bilschirmauflösung oder Tonqualität, sondern wortwörtlich auf eine neue Dimension gehoben.

ComputerBase hat Informationen zu diesem Artikel von HP im Rahmen einer Veranstaltung des Herstellers in New York unter NDA erhalten. Die Kosten für Anreise, Abreise und Hotelübernachtung wurden von HP getragen. Eine Einflussnahme des Herstellers auf die oder eine Verpflichtung zur Berichterstattung bestand nicht. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

Dieser Artikel war interessant, hilfreich oder beides? Die Redaktion freut sich über jede Unterstützung durch ComputerBase Pro und deaktivierte Werbeblocker. Mehr zum Thema Anzeigen auf ComputerBase.

Apps & Mobile Entwicklung

OpenWrt 25.12.2: Zweiter März-Patch bessert bei freier Router-Firmware nach

Am 5. März wurde die neue Hauptversion des auf Linux basierenden, freien Router-Betriebssystems OpenWrt in Version 25.12.0 veröffentlicht. Innerhalb von nur einem Monat wurden nun bereits zwei Patches veröffentlicht, auch, aber nicht nur wegen nötiger Fehlerkorrekturen.

Patch 2 legt Fokus auf Fehlerkorrekturen

Nachdem Patch Nummer 1 am 18. März vor allem aufgrund der gefundenen Schwachstellen veröffentlicht wurde, stellt Patch Nummer 2 nun primär Lösungen für gefundene Fehler bereit:

- APM821xx: U-Boot-Definitionen korrigiert (Netgear, WD, Meraki); PCIe-Boot auf Meraki MX60 behoben.

- ATH79: Initramfs-Boot für Huawei AP5030DN/AP6010DN korrigiert; VLAN-Tagging auf Dual-CPU-Geräten behoben.

- RAMIPS: Kernel-Dekomprimierungsfehler bei ELECOM WRC-X1800GS behoben; Initramfs-Kerneladresse für TP-Link EAP615-Wall korrigiert.

- ATH79: Entfernt unnötige WiFi-Pakete vom Mikrotik RB750r2.

- IPQ40xx: ART-Partition für Linksys Velop korrigiert; MAC-Adressen für Linksys eMMC-Geräte behoben.

- RAMIPS: MAC-Adresse für Xiaomi Mi AC2100 korrigiert.

- Lantiq xrx200 (BT HomeHub 5A): Failsafe-Modus repariert, LAN-Ports 1&2 funktionieren wieder.

- MediaTek BPI-R4: SFP+-Module nach Update wieder nutzbar.

- Realtek: D-Link Lüftersteuerungsskript korrigiert.

Auch rund um das Thema WLAN gibt es weitere Fehlerbehebungen und Verbesserungen:

- WLAN-Skripte: 160 MHz-Kanäle funktionieren jetzt korrekt; SU-Beamforming-Antennenanzahl wird richtig übergeben.

- Hostapd: Speicherleck in der Radio Resource Management-Schnittstelle behoben.

- mac80211/ath12k: Temperatur-Sensoren für QCA/IPQ-Geräte hinzugefügt.

- mac80211/ath9k: GPIO-Masken aus Device Tree korrekt verarbeitet.

- Schwere Latenzprobleme auf 2,4 GHz (bis zu 30 Sekunden Verzögerung) für viele MediaTek-Geräte behoben.

- Weitere Stabilitäts- und Multi-Link-Operation-Korrekturen für MT76-Chipsätze (MT7615, MT7915,

MT7996, MT7992, MT792x), u. a. Beacon-Monitoring, Link-Handling und Scan-Race-Bugs.

Schnelle Fehlerbehebungen

Das zweite große Update in so kurzer Zeit zeigt, dass die OpenWrt-Community die Weiterentwicklung des freien Router-Betriebssystems sehr engagiert vorantreibt. Die sehr heterogene Hardware-Basis multipliziert natürlich die möglichen Fehlerquellen, dennoch erlaubt OpenWrt den Weiterbetrieb von Hardware, die von den jeweiligen Herstellern längst nicht mehr mit Updates versorgt werden und liefert zudem Funktionalitäten, die es in der Hersteller-Software nie gegeben hat, obwohl es möglich gewesen wäre, wie zum Beispiel Mesh.

Ausblick

Die Release Notes von 25.12.2 nennen bereits weitere bekannte Fehler, die wohl mit dem nächsten Update behoben werden. Dazu zählen mögliche WLAN-Probleme beim Einsatz eines eines Google Pixel 10 und der WPA3-WLAN-Verschlüsselung sowie ein Problem beim Wechsel von einem zu einem anderen Access Point (Fast Transition) bei der gleichzeitigen Nutzung von WPA3.

-

Künstliche Intelligenzvor 1 Monat

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 4 Wochen

Social Mediavor 4 WochenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

UX/UI & Webdesignvor 2 Monaten

UX/UI & Webdesignvor 2 MonatenEindrucksvolle neue Identity für White Ribbon › PAGE online

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenAumovio: neue Displaykonzepte und Zentralrechner mit NXP‑Prozessor

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonateneHealth: iOS‑App zeigt Störungen in der Telematikinfrastruktur

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenX3D² bestätigt: Der AMD Ryzen 9 9950X3D2 mit doppeltem 3D V-Cache kommt!

-

Entwicklung & Codevor 3 Wochen

Entwicklung & Codevor 3 WochenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB