Apps & Mobile Entwicklung

Garmin Smartwatch-Nutzer warten seit Jahren auf diese Funktion

Messaging ist nicht unbedingt die Stärke von Smartwatches mit ihren kleinen Displays. Hin und wieder kann eine Messaging-App am Handgelenk aber sehr nützlich sein. Jetzt hat Garmin dem Wunsch der Nutzer nachgegeben und eine offizielle WhatsApp-App auf seine Smartwatches gebracht.

Garmin hat offiziell die WhatsApp-App für seine Geräte angekündigt. Nach Angaben des Unternehmens ist es die erste und einzige Messaging-App eines Drittanbieters, die auf seiner Plattform verfügbar ist. Diese Veröffentlichung folgt auf die Einführung der offiziellen WhatsApp-App für die Apple Watch im vergangenen Jahr.

Welche Garmin-Uhren unterstützen WhatsApp?

Nutzer können die WhatsApp-App kostenlos aus dem Garmin Connect IQ Store herunterladen. Sie unterstützt eine Auswahl von Garmin-Uhrenmodellen, vor allem die neueren, darunter: Venu 4, Venu X1, Vivoactive 6, Forerunner 570, Forerunner 970, Fenix 8, Fenix 8 Pro, Fenix E, Enduro 3, und D2 Air X15.

Die Liste ist zwar noch überschaubar, deckt aber viele der beliebtesten aktuellen Modelle von Garmin ab. Die Unterstützung für diese Uhren hängt wahrscheinlich von den Hardware-Funktionen ab. Älteren Modellen fehlt oft ein Touchscreen zum Tippen und sie haben langsamere Prozessoren. Dass Garmin die Forerunner 165 trotz ihres Touchscreens nicht berücksichtigt hat, ist allerdings enttäuschend.

Die App funktioniert entweder mit einem Android- oder einem iPhone-Gerät, das mit der Smartwatch gekoppelt ist. Allerdings muss die Bluetooth-Verbindung des Wearables mit dem Telefon immer aktiv bleiben, da die App keine Wi-Fi-Verbindung unterstützt.

Was man mit WhatsApp auf Garmin machen kann

Mit der offiziellen WhatsApp-App können Nutzer eingehende Nachrichten lesen und über die integrierte Tastatur antworten. Auch Emojis können eingefügt und verschickt werden. Neben der Eingabe neuer Nachrichten sind auch mehrere voreingestellte Schnellantworten verfügbar. Benutzer können die letzten Nachrichten anzeigen oder den Chatverlauf der letzten 10 Nachrichten durchsuchen.

Die Anzeige von Medienanhängen wie Fotos oder GIFs wird nicht unterstützt, was angesichts der begrenzten Bildschirmgröße und der Hardwarebeschränkungen verständlich ist. Sprachanrufe über WhatsApp sind ebenfalls nicht verfügbar, aber die Nutzer können eingehende Anrufe sehen und sie ablehnen.

Bemerkenswert ist, dass es keine Diktierfunktion für Text gibt, obwohl viele dieser Uhren über ein Mikrofon verfügen. Diese Funktion wird möglicherweise mit einem zukünftigen Update nachgeliefert.

Auch wenn die Funktionalität einfach bleibt, ist sie für viele Nutzer wirklich praktisch, z. B. beim Training im Fitnessstudio oder auf dem Sportplatz, wenn das Telefon in einer Tasche verstaut ist, oder beim Radfahren auf Straßen oder Wegen.

Habt ihr eure Garmin-Smartwatch schon für Messaging genutzt? Findet ihr die zusätzliche Funktion mit WhatsApp nützlich? Sagt es uns unten in den Kommentaren.

Apps & Mobile Entwicklung

Google-Smartphones: Pixel 11 mit RGB-Anzeige, 2-nm-SoC und MediaTek-Modem

Mitte August dürfte Google die aus vier Smartphones bestehende Pixel-11-Serie vorstellen. Ein umfangreicher Leak gibt vorab Einblick in die technische Ausstattung der Google-Smartphones. Dazu gehört mit dem Tensor G6 auch ein neuer 2-nm-Chip von Google. Die Serie soll außerdem neue Kamerasensoren und eine RGB-Anzeige erhalten.

Der aktuelle Leak stammt von Mystic Leaks auf Telegram und knüpft an einen früheren Beitrag desselben Nutzers an, der Wallpaper des Pixel 11 Pro Fold zeigte.

Tensor G6 aus 2-nm-Fertigung von TSMC

Dem aktuellen Beitrag zufolge plant Google für den Spätsommer die Ankündigung von vier Smartphones: Pixel 11 („Cubs“), Pixel 11 Pro („Grizzly“), Pixel 11 Pro XL („Kodiak“) und Pixel 11 Pro Fold („Yogi“). Allen vier Modellen gemein sei der Tensor G6, den Google bei TSMC in N2 fertigen lasse. Der letztjährige Tensor G5 war nach zwei Generationen in 4 nm der erste 3-nm-Chip von Google.

MediaTek M90 statt Samsung-Modem

Der Chip setze auf die aktuellen C1-CPU-Kerne von Arm, genauer gesagt einen C1-Ultra mit 4,11 GHz, vier C1-Pro mit 3,38 GHz und zwei C1-Pro mit 2,65 GHz. Genannt werden in dem Leak außerdem der neue Sicherheitschip Titan M3 („Epic“), die IMG PowerVR CXTP-48-1536 als GPU, eine neue TPU („Santafe“), ein neuer GXP-Bildsignalprozessor („Metis“) und nach fünf Generationen mit Samsung-Exynos-Modem auch das MediaTek M90 als neues Mobilfunkmodem.

Project Toscana noch nicht einsatzbereit

Der neue Chipsatz soll in allen vier Smartphones zum Einsatz kommen. Nicht in die Geräte geschafft habe es „Project Toscana“, die neue, auf Infrarot basierende Face-Unlock-Technologie von Google. Wird auf das Entsperren per Fingerabdruck verzichtet, kommt für die Gesichtsentsperrung weiterhin eine klassische Kamera zum Einsatz.

RGB-LED-Anzeige statt Thermometer

Nicht länger anzutreffen sei zudem das bislang bei den Pro-Modellen in der Kameraleiste integrierte Thermometer. Stattdessen werde Google eine RGB-LED-Anzeige verbauen, die in gewissem Maße Ähnlichkeiten zum Nothing Glyph Interface aufweise, jedoch kleiner ausfalle. Bei welchen Apps die Anzeige zum Einsatz kommt oder welche Statusinformationen darüber angezeigt werden können, ist noch nicht bekannt.

Neue Sensoren und Linsen für Kameras

Aufgeführt werden in dem Beitrag auch neue Kameras. Das Pixel 11 soll einen 50-MP-Sensor („chemosh“) und eine neue Linse („vesta“) erhalten. Dem Pixel 11 Pro wird ebenfalls ein neuer Sensor („bastet“) und eine neue Linse („vesta“) für die Hauptkamera nachgesagt, aber auch ein Upgrade von Sensor („barghest“) und Linse („chonky“) des Teleobjektivs stehe an – gleiches gilt für das Pixel 11 Pro XL.

Apps & Mobile Entwicklung

HyperX Clutch Talon: Gamepad kann mit Zubehör und 3D-Druck angepasst werden

HPs Gaming-Sparte Hyper X sucht beim High-End-Controller Clutch Talon eine Nische in universeller Nutzung. Das Gamepad kann am PC, Xbox-Konsolen und an Android-Smartphones für Eingaben genutzt werden. Dabei helfen eine Halterung und modulare Bestandteile mit Kompatibilität zu 3D-Druckern.

Der Clutch Talon folgt dem Xbox-Layout mit diagonal angeordneten Thumbsticks. Für sie sowie die Trigger nutzt das Gamepad Hall-Effekt-, aber noch keine TMR-Technik, die etwas akkurater, flotter und stromsparender zu Werke gehen soll. Stick Drift als Problem eliminieren aber auch diese Sticks. Zusatztasten gibt es nur zwei Stück in Form von Paddles an der Unterseite, ansonsten hält sich HyperX an das Regellayout. Da über die Tastentechnik kein Wort verloren wird, dürften Rubberdome-Switches zum Einsatz kommen.

Modularität und 3D-Druck

Modularität ist HyperX wichtiger. Trigger, Sticks, Back Paddles, D-Pad, und Abdeckplatten auf Ober- und Unterseite können ausgetauscht werden. Die Abdeckplatten können zudem dank Dateien auf der HyperX-Unterseite auf Printables im 3D-Drucker selbst gefertigt werden. Wie das Zubehör aussehen kann und welche exakte Form es im Lieferumfang hat, lässt sich mangels Bildmaterials allenfalls abschätzen.

Tasten können mit der HyperX-Software „Engenuity“ („Ingenuity“, dt. Erfindergeist) in vier Profilen neu belegt werden. Einstellen lassen sich außerdem Auslösepunkte der Trigger und Totzonen der Sticks.

Daten werden per Bluetooth, Kabel oder einem 2,4-GHz-„Hochgeschwindigkeits-Dongle“ übertragen. Von 8.000 Hz Abfragerate schreibt HyperX jedoch nichts. Da „Hochgeschwindigkeit“ kein fest definierter, sondern nur suggestiver Begriff ist, muss von 1.000 Hz ausgegangen werden.

Ein integrierter 1.000-mAh-Akku soll eine Laufzeit von maximal 30 Stunden gewährleisten. Auf das Gewicht wirkt sich das kaum aus: Mit 275 Gramm wiegt der Clutch Talon marginal weniger als das Xbox-Gamepad. Dennoch soll er mobil genutzt werden. Ein ansteckbarer Clip ermöglicht die Befestigung von Smartphones, um unterwegs spielen zu können. Neben Android-Geräten stehen Xbox Series X|S und der PC auf der Kompatibilitätsliste.

Preis und Verfügbarkeit

Im Handel soll das Clutch Talon ab Juni verfügbar sein, die Preisempfehlung beziffert HyperX auf rund 160 Euro.

Apps & Mobile Entwicklung

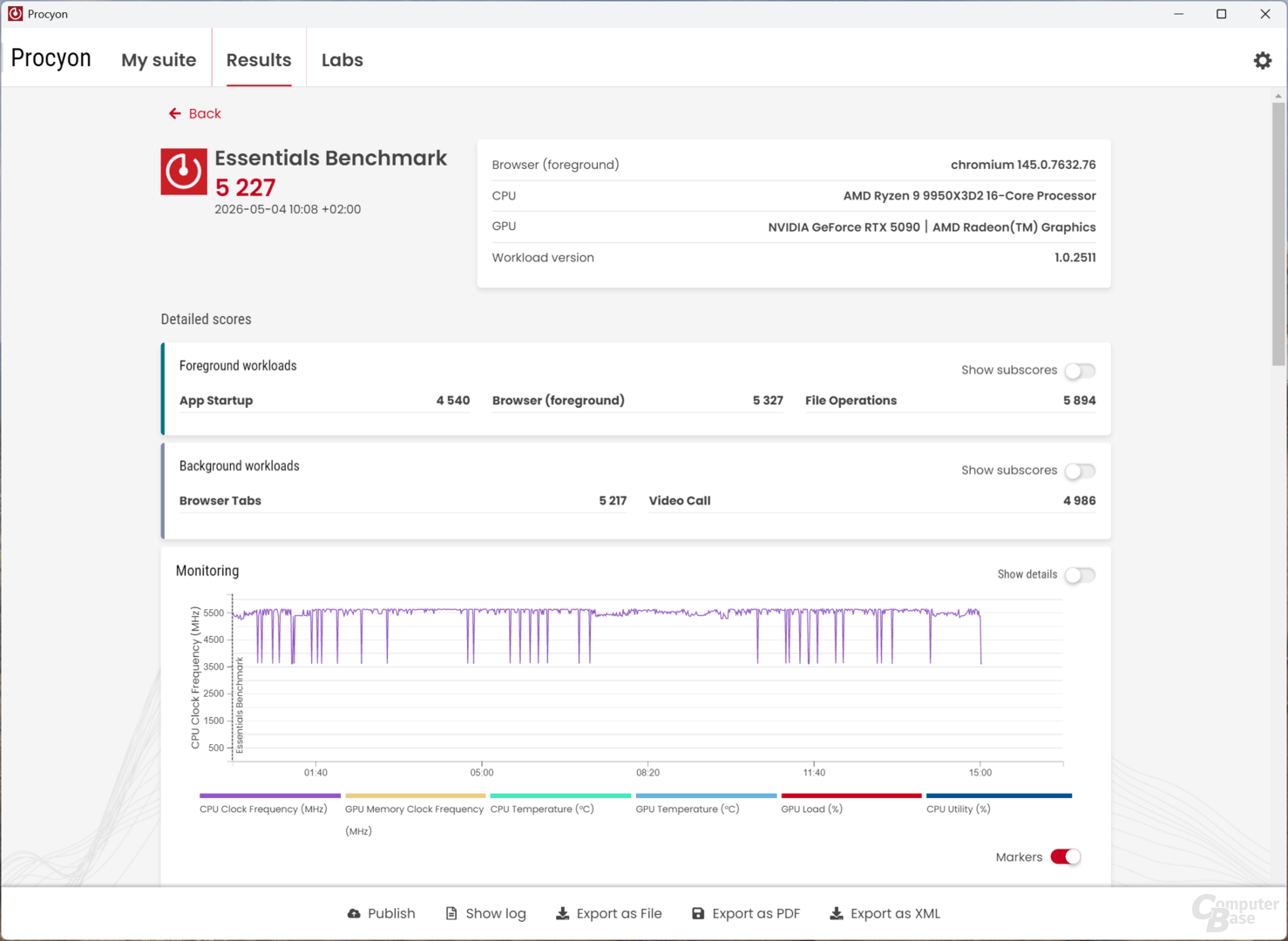

UL Procyon Essentials: Im neuen Real-World-Benchmark ist vieles ähnlich schnell

UL bringt mit Procyon Essentials einen neuen Benchmark heraus, der mit Real-World-Szenarien und mehr dem PCMark 10 Konkurrenz macht. Parallel dazu wird aber noch mehr aus dem Alltag simuliert, darunter Videokonferenzen, das Öffnen verschiedener Anwendungen und sogar etwas lokale KI. ComputerBase hat erste Testergebnisse.

Der nächste Versuch eines Real–World-Benchmarks

Realitätsnahe Benchmarks versuchen viele Firmen seit Jahren immer mal wieder zu bauen – vor fünf Jahren beispielsweise der durch Intel gepushte CrossMark. Wie so oft werden sie aber schnell doch wieder von der Realität überholt, die Aussagekraft bleibt letztlich begrenzt oder ist nur von kurzer Dauer. UL versucht es mit dem Procyon Essentials nun aber noch einmal, und hört dabei auch auf das, was Nutzer fordern.

Denn zur Normalität gehört es heute durchaus, dass im Browser hin und wieder 30 Tabs (oder auch viel mehr) offen sind. Und dazu noch verschiedene Programme, ein Video-Call, der AI-Assistent für die Textzusammenfassung oder Übersetzung und die eine oder andere Kleinigkeit kommen können. All diese „alltäglichen Aufgaben“ soll Essentials nun simulieren. Anders als bei den bisherigen Tests wird keine weitere Software benötigt. Die Basis bilden das Programm und ein Browser, kein Office mit Excel oder Word muss installiert sein.

Simuliert werden die Anwendungen durch Chromium, LibreOffice Calc, LibreOffice Impress und VSCodium. Ge- und entpackt wird über das integrierte Zip-Tool aus Windows und 7-Zip. Zudem wird WindowsML mit Support für GPUs und NPUs genutzt, verwendbar ab Intel Core Ultra, AMD Ryzen AI 300 und Qualcomm Snapdragon X1 Elite. Das System muss stets mindestens 16 GByte RAM vorweisen können – ältere, günstige PCs sind damit zum großen Teil direkt von der Verwendung ausgeschlossen, wenngleich der Anbieter betont, CPUs ab Core i-10000 und AMD Ryzen 5000G zu unterstützen, dazu GeForce RTX 2000 oder neuer oder Radeon mit mindestens RDNA-1-Architektur.

Die Besonderheit liegt im Multitasking und der Ausführung. Absichtlich sind einige Programme im Vordergrund, andere im Hintergrund platziert. Auch ein App-Startup-Test hat es wieder in den Benchmark geschafft, der seit dem PCMark 10 vermisst wurde.

Benchmark-Ergebnisse der Redaktion

Um einen ersten Realitätsbezug zu bekommen – und dabei auch feststellen zu können, ob sich das Programm für zukünftige Tests eignet – wurde der Procyon Essentials zuerst auf zwei Desktop-Systemen der Redaktion ausgeführt. Zum einen auf dem AMD Ryzen 9 9950X3D2 Dual Edition (Test) samt Asus ROG Astral RTX 5090, also dem Besten, was es im Mainstream-Desktop aktuell zu kaufen gibt, und zum anderen mit einer Plattform, die sich aus Intel Core i9-12900K und AMD Radeon 9070XT zusammensetzt.

Das sehr nah beieinander liegende Endergebnis zeigt ein vermutetes Problem des Benchmarks: Die Aussagekraft lässt eher zu wünschen übrig. Es lässt sich bei potenteren Desktop-Systemen schlichtweg nur feststellen, dass alles wie gewünscht funktioniert – aber das wusste man vermutlich bereits vor dem Benchmark.

Deshalb hat die Redaktion neben den zwei Desktop-Systemen einen Intel Core Ultra X7 358H, Codename Panther Lake, den modernsten Notebook-Prozessor, mit ins Boot geholt. Mit 4.455 Punkten fällt das Endergebnis der Notebook-CPU mit iGPU dann auch nur etwas geringer aus. Bedenkt man jedoch, dass ein 9950X3D2 mit RTX 5090 eigentlich in einer ganz anderen Liga spielen müsste, bleibt der nicht einmal 20 Prozent große Vorsprung sehr überschaubar. Die Aussagekraft für halbwegs moderne Hardware bleibt entsprechend eingeschränkt.

Am 5. Mai wird der Procyon Essentials offiziell von UL für Windows auf x86- und Arm-Prozessoren freigegeben – eine Mac-Version gibt es nicht. Die Veröffentlichung erfolgt über die typischen Kanäle der offiziellen Webseite. Procyon kostet je nach Einsatzgebiet unterschiedlich viel.

ComputerBase hat die Vorabversion von Procyon Essentials vorab unter NDA vom UL Solutions Benchmarks team erhalten. Die einzige Vorgabe war der frühestmögliche Veröffentlichungszeitpunkt.

-

Künstliche Intelligenzvor 2 Monaten

Top 10: Die beste kabellose Überwachungskamera im Test – Akku, WLAN, LTE & Solar

-

Social Mediavor 2 Monaten

Social Mediavor 2 MonatenCommunity Management und Zielgruppen-Analyse: Die besten Insights aus Blog und Podcast

-

Social Mediavor 3 Monaten

Social Mediavor 3 MonatenCommunity Management zwischen Reichweite und Verantwortung

-

Künstliche Intelligenzvor 3 Monaten

Künstliche Intelligenzvor 3 MonatenSmartphone‑Teleaufsätze im Praxistest: Was die Technik kann – und was nicht

-

Apps & Mobile Entwicklungvor 3 Monaten

Apps & Mobile Entwicklungvor 3 MonatenIntel Nova Lake aus N2P-Fertigung: 8P+16E-Kerne samt 144 MB L3-Cache werden ~150 mm² groß

-

Entwicklung & Codevor 2 Monaten

Entwicklung & Codevor 2 MonatenCommunity-Protest erfolgreich: Galera bleibt Open Source in MariaDB

-

Künstliche Intelligenzvor 2 Monaten

Künstliche Intelligenzvor 2 MonatenBlade‑Battery 2.0 und Flash-Charger: BYD beschleunigt Laden weiter

-

Social Mediavor 1 Monat

Social Mediavor 1 MonatVon Kennzeichnung bis Plattformpflichten: Was die EU-Regeln für Influencer Marketing bedeuten – Katy Link im AllSocial Interview